この記事の3行まとめ

- AppleがMRデバイス「Apple Vision Pro」を発表。2024年初旬に米国で発売

- 「visionOS」を搭載し、目や指、声を使った操作が可能

- 「M2」チップと、新開発の「R1」チップを搭載している

2023年6月5日(現地時間)、Appleは「空間コンピュータ」と説明するMRデバイス「Apple Vision Pro」を発表しました。

同製品は米国向けに2024年初旬に発売され、販売価格は3,499ドル(1ドル140円換算で489,860円)から。その他の国や地域では2024年後半から販売する予定としています。

「Apple Vision Pro」のOSは、macOS/iOS/iPadOSの基盤を引き継いだ、空間オペレーティングシステム「visionOS」。

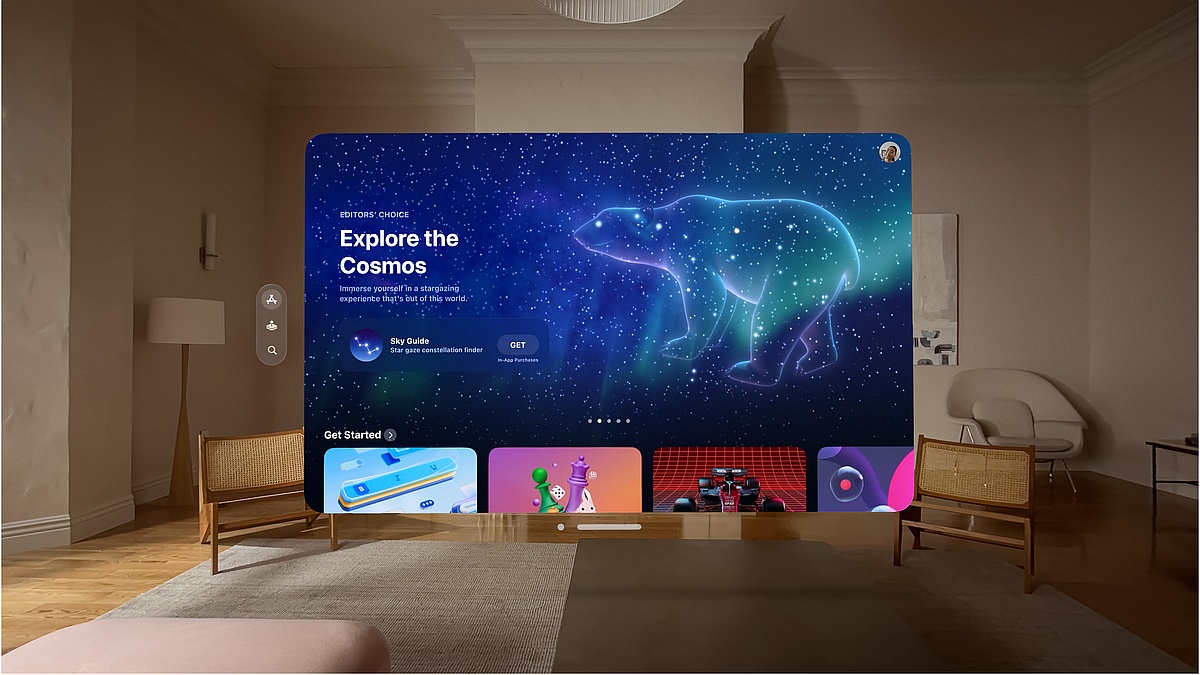

3Dのインターフェイスを備え、コンテンツが現実の空間に浮かぶように表示されます。各アプリは好みの大きさに変更も可能。

現実の物体にコンテンツの影が落ちるように描画される(画像はニュースリリースから引用)

操作は、目や手指の動き、音声などで行えます。アイコンなどを見るだけで強調表示され、指を合わせる動作で選択、軽いフリックでスクロールといった操作ができます。

また、こうした操作は、腕を下げた楽な姿勢でも行えます。さらに、たとえば検索フィールドでマイクボタンを見て話せば、テキスト入力が可能です。

(動画は製品ページより引用)

(画像は製品ページより引用)

それ以外にも、Magic KeyboardとMagic Trackpadでの操作もサポートされています。

(動画はニュースリリースから引用)

iPhone/iPad向けのアプリもスムーズに動作するとしています。また、Apple ArcadeのvisionOSゲームは、周囲の空間を利用して遊べるとのこと。

Bluetooth接続するゲームパッドも利用できる(動画は製品ページより引用)

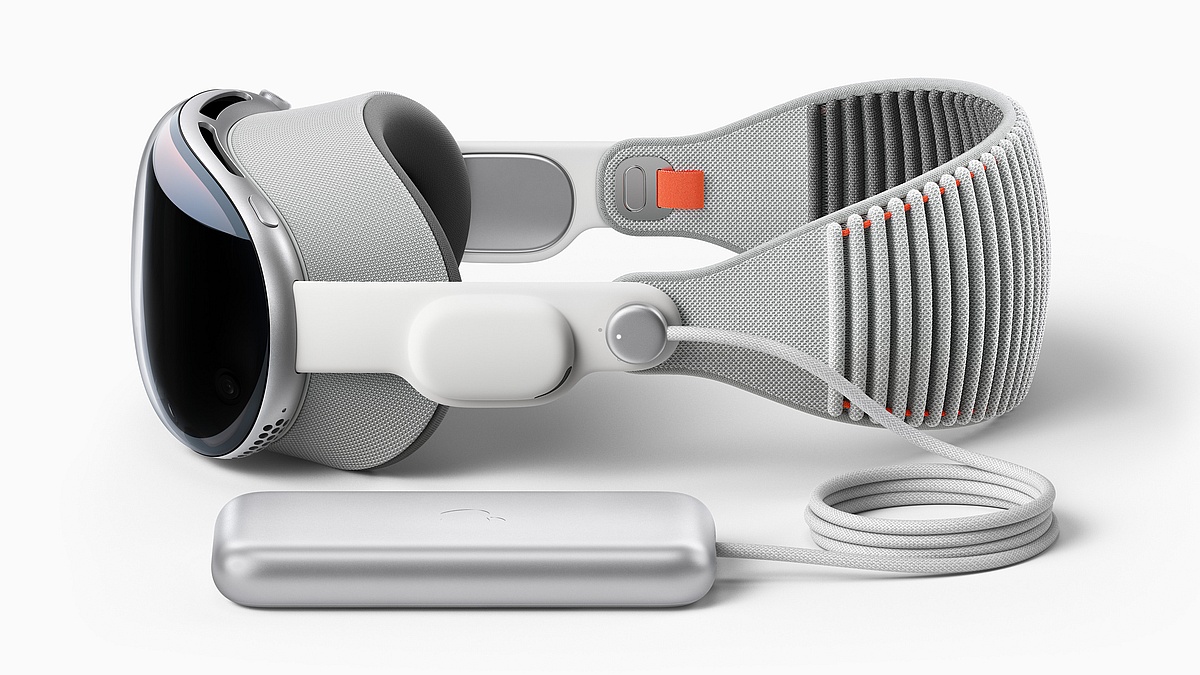

「Apple Vision Pro」は、ケーブルで電源と接続することで駆動します。外部バッテリー使用時の駆動時間は、最大2時間。

スピーカーは両耳の横側に位置している(画像はニュースリリースから引用)

同製品が搭載している2つのマイクロOLEDディスプレイは、合計2,300万画素。視力矯正用に、別売りでZEISSのレンズも提供されます。

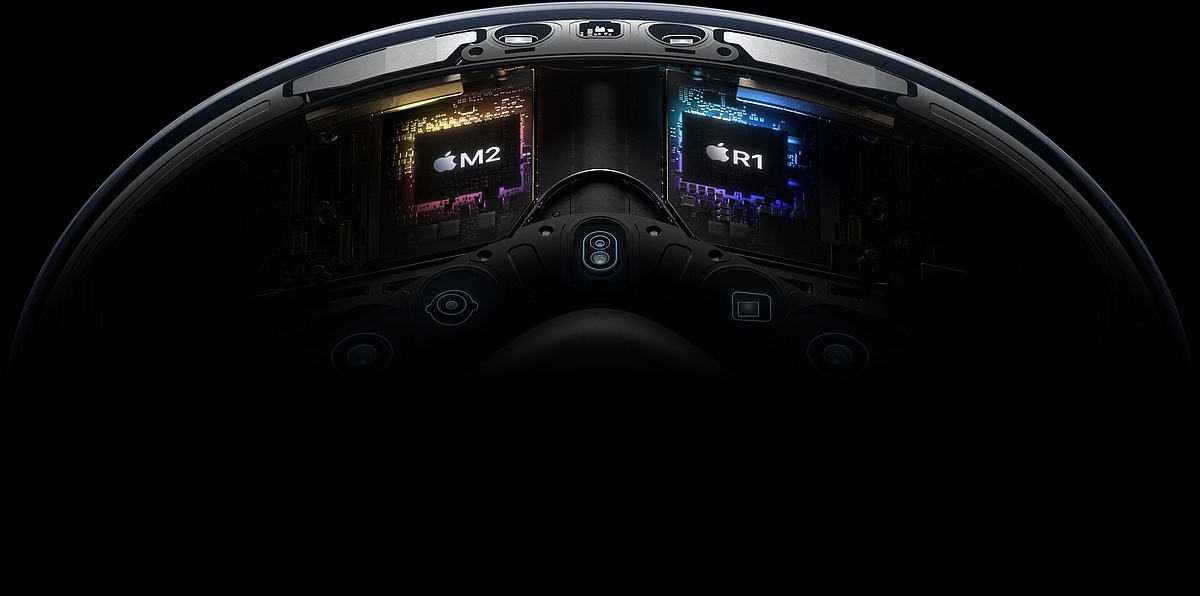

SoCは、Macにも採用されている「M2」チップと、新開発の「R1」チップ。R1チップは本製品が搭載する12のカメラ、5つのセンサー、6つのマイクの入力処理を担当し、12ミリ秒で新しいイメージをディスプレイに伝送できるとしています。

(画像は製品ページより引用)

センサー・カメラ類のなかには、LiDARとTrueDepthも(画像は製品ページより引用)

アイトラッキングにはLEDと赤外線カメラを活用。なお、ユーザーの虹彩で認証する「Optic ID」にも、各種カメラ・センサーは用いられている(画像は製品ページより引用)

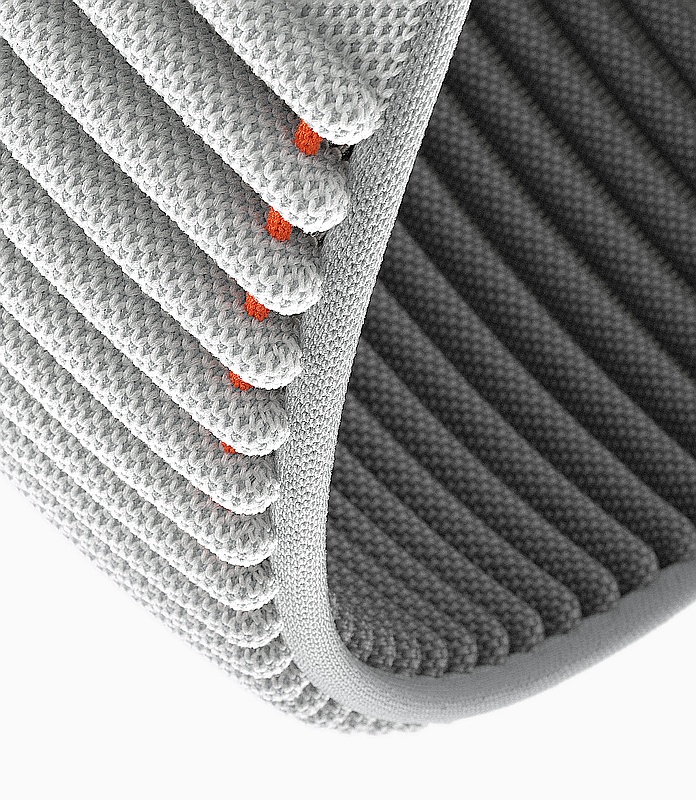

ヘッドバンドは3Dニットで、独自のリブ構造によりクッション性、通気性、ストレッチ性を実現しているとのこと。

(画像はニュースリリースから引用)

本製品には「EyeSight」という技術も備えています。これは、人が近づくとディスプレイ上にその人が見えるようになりつつ、相手からはユーザーの目を表示するというもの。

また、アプリ使用時などは、ユーザーが何に集中しているのかを、視覚的に周囲に見えるようになります。

(画像はニュースリリースから引用)

そのほかにも、Apple初の3Dカメラを搭載。3Dで写真や動画を撮影でき、そのシーンの空間を再現した再生が可能としています。

「Apple Vision Pro」の詳細は、ニュースリリースや製品ページをご確認ください。

ニュースリリース「Apple Vision Pro」製品ページ