この記事の3行まとめ

- Apple、WWDC23にてObject Capture for iOSを発表

- iPhoneやiPadのみで3Dモデルの生成が可能に

- Guide capture機能により簡単にキャプチャーが可能

Appleは、2023年6月5日(現地時間)に開催されたWWDC23でiOS用のObject Captureを発表しました。

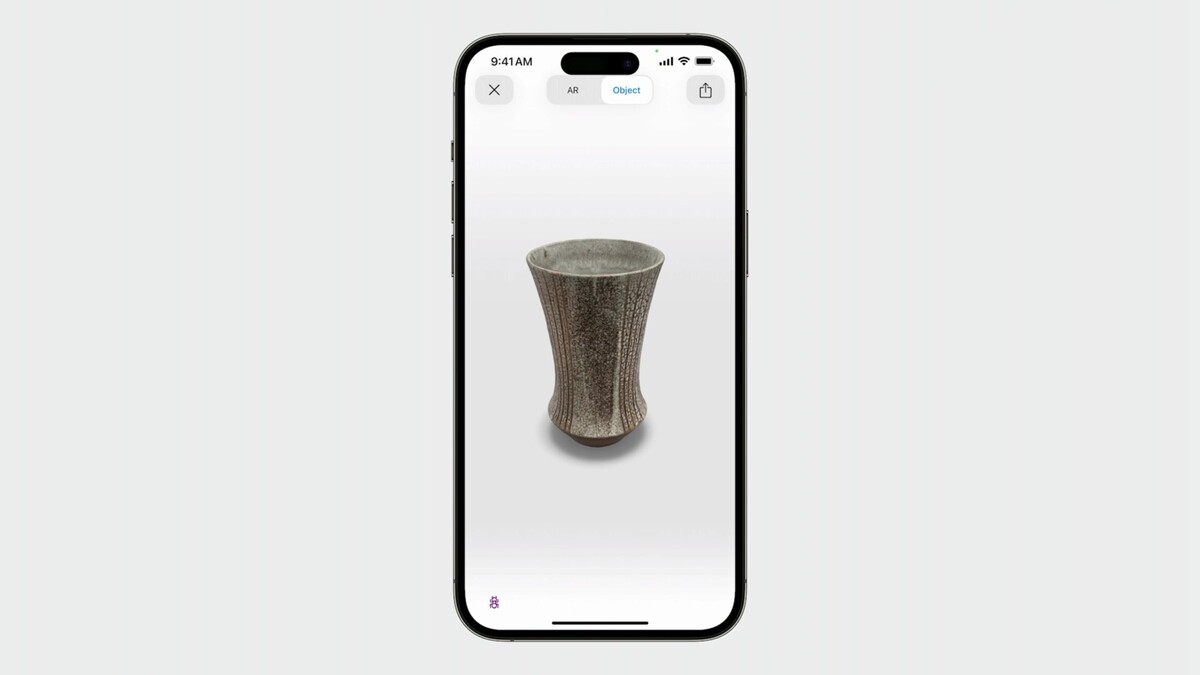

Object Captureのデモアプリを使用して花瓶を生成している(画像はWWDC23セッションより引用)

Object Captureは撮影画像から3Dモデルを生成する機能です。iPhoneまたはiPadで異なる角度の写真を撮影し、Object Capture APIに渡すことで3Dモデルが生成されます。WWDC21で発表された際はMacOSのみの機能でしたが、WWDC23でiOSで3Dモデルを生成可能なObject Capture APIが発表されました。

セッションでは、新しいObject Capture APIを使ったサンプルアプリのデモが行われました。iPhoneで撮影した花瓶の3Dモデルが生成されている様子が確認できるほか新機能についても紹介されています。

写真だけでは生成できない部分がある(画像はWWDC23セッションより引用)

LiDARを使用して写真だけでは生成できない部分を生成(画像はWWDC23セッションより引用)

LiDAR(※)を使用することで、写真のみではキャプチャーしきれなかった質感のあるオブジェクトにも対応できるようになりました。LiDARでは点群データを取得するため、画像から得るRGBの情報と組み合わせることで、今まで出来なかったキャプチャーが可能になりました。

※光を照射し、反射光の情報をもとに対象物までの距離や形状を計測する技術。LiDARスキャナーはiPhone 12 Pro以降のProシリーズに搭載されている

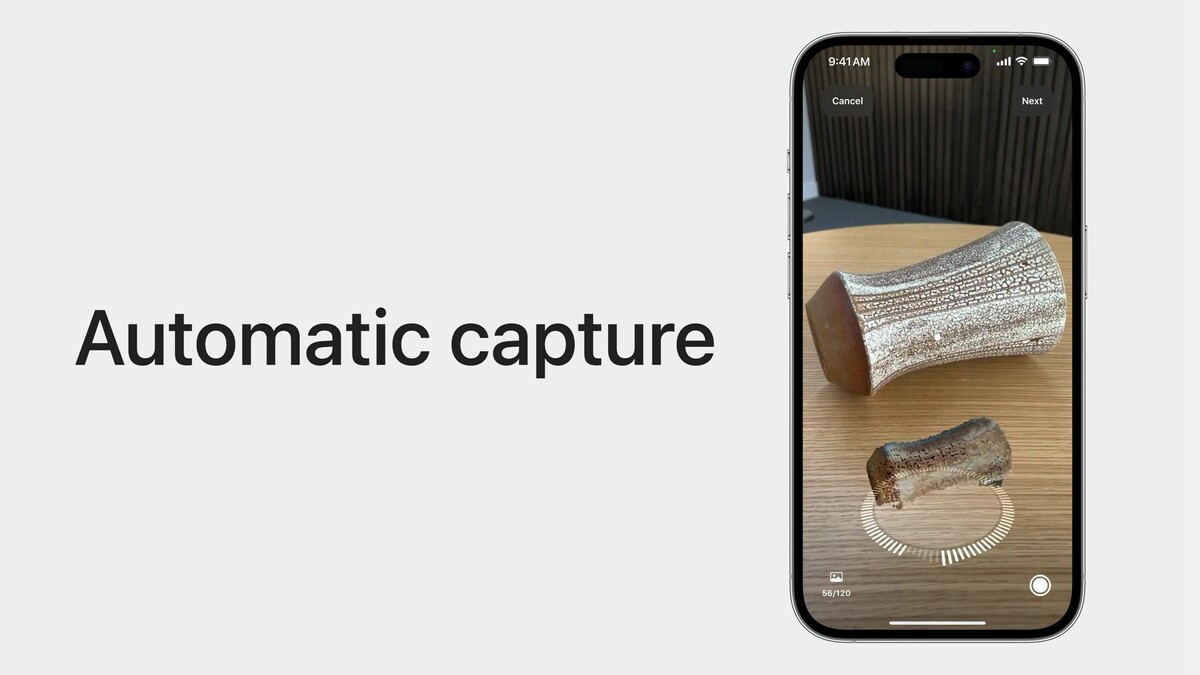

ユーザーはシャッターを切る必要がなく、自動的にキャプチャーされる(画像はWWDC23セッションより引用)

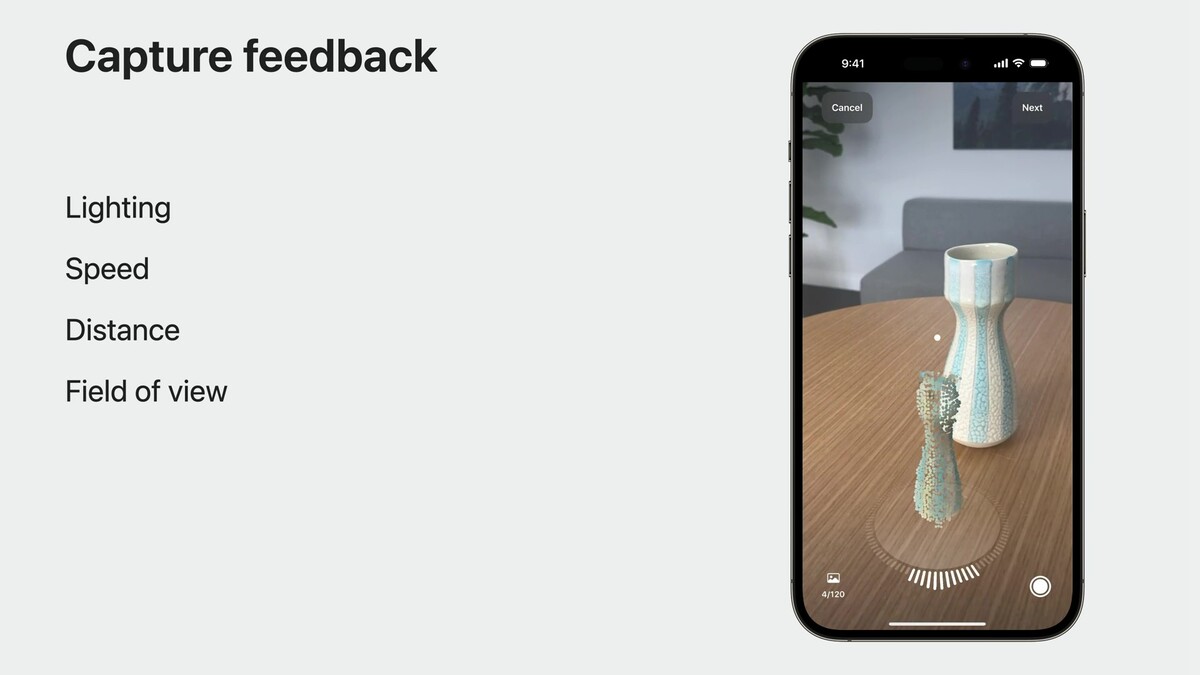

キャプチャーに対して適切なフィードバックが表示される(画像はWWDC23セッションより引用)

Guide captureは、画像やLiDARデータを自動的にキャプチャーする機能です。キャプチャー中にフィードバックを返す機能やオブジェクトを反転させる必要があるかなどのガイド機能が含まれています。ユーザーがシャッターを切る必要はなく、自動でキャプチャーされた画像の中から3Dモデル生成に適切な画像を選択するため、多くの角度から撮影することがポイントとなりそうです。

これらの機能のほかにObject Capture APIの使い方や、モデル再構築機能の強化点についても紹介されています。詳細は、WWDC23「Meet Object Capture for iOS」をご確認ください。

WWDC23「Meet Object Capture for iOS」