左から、ゼネラルマネージャー 西林 卓也氏(ソニー・ホンダモビリティ)、ソリューションアーキテクト 向井 秀哉氏(エピック ゲームズ ジャパン)、ソフトウェアエンジニア Pierre Mizzi/ピエール・ミッチ氏(キュー・ゲームス)、ソフトウェアエンジニア 山口 雄也氏(ソニー・ホンダモビリティ)

ソニー・ホンダモビリティが目指す「人とモビリティの関係の再定義」

まずは、ソニー・ホンダモビリティ(以下、SHM) ゼネラルマネージャー 西林 卓也氏が登壇し、同社のビジョンと『AFEELA 1』のコンセプトを紹介しました。

SHMが掲げる目標は「Redefine the Relationship Between People and Mobility(人とモビリティの関係を再定義する)」。このビジョンを実現するために、同社は「3A」と呼ばれる3つのコンセプトを掲げています。

Autonomous(自律性) :自律走行技術の追求 Augmentation(拡張性) :テクノロジーによる体験の拡張 Affinity(親和性) :人と車の融和的な関係性

これらは単なる車のコンセプトではなく、会社全体のコンセプトとして位置づけられています。

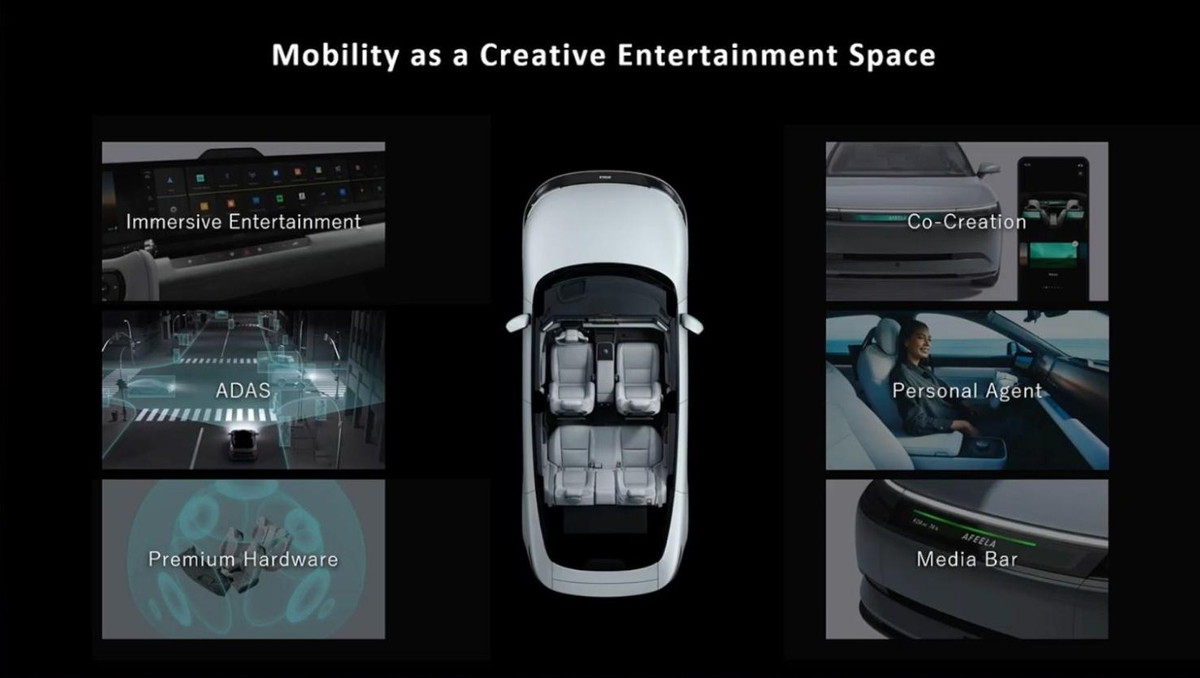

クリエイティブエンターテインメントスペースとしての『AFEELA 1』 『AFEELA 1』は、従来の自動車の枠を超えた「クリエイティブエンターテインメントスペース」として設計されています。西林氏は6つの主要機能群を紹介しました。

1. イマーシブエンターテインメント 没入感のあるエンターテインメント環境を車内に構築。フロントピラー同士を結ぶ横長の「パノラミックスクリーン」を採用し、広大な視界でコンテンツを楽しめます。

2. ADAS(先進運転支援システム) Level 2+の自動運転技術を搭載。Level 3ではなくLevel 2+としているのは、「極力どこでも使える」システムを目指しているためです。

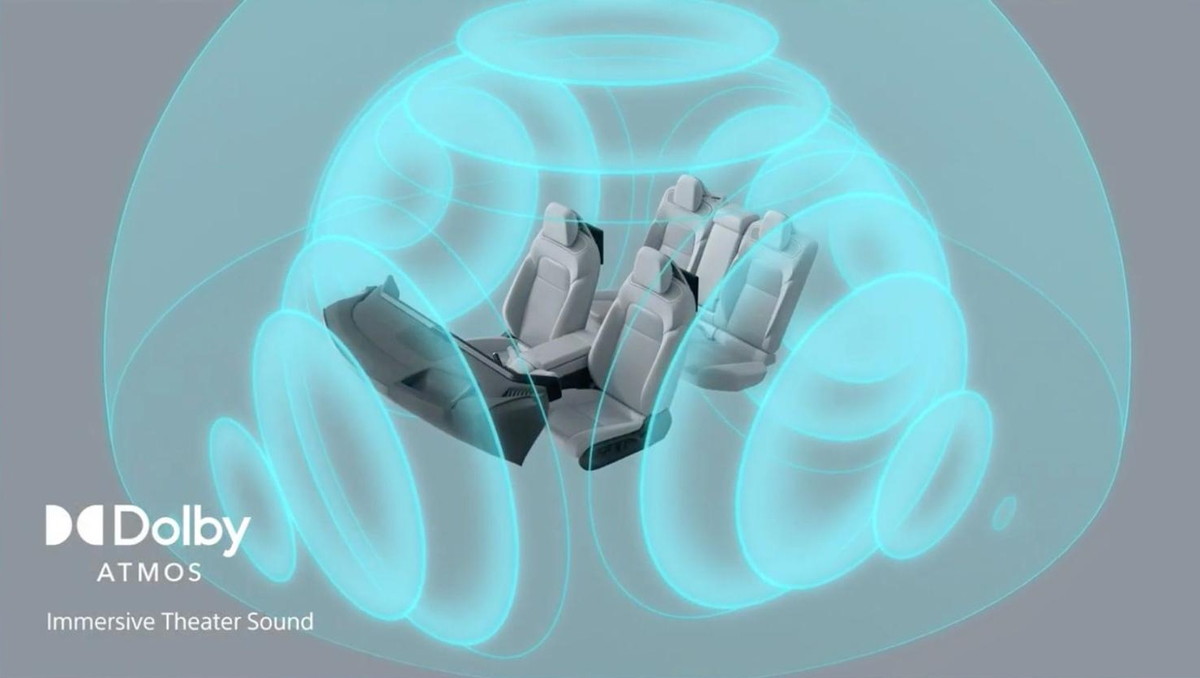

3. プレミアムハードウェア ソニーが培ってきたオーディオ技術を投入。Dolby Atmos対応の立体音響、96kHz以上のハイレゾオーディオサポート、各座席を3つのゾーンに分けて異なる音を再生できる「ゾーナルサウンド」機能を実装しています。

4. コ・クリエーション 業界の垣根を超えた共創 により、新しい価値を創造。本セッション自体が、自動車メーカー、ゲームエンジン開発会社、ゲーム開発会社という異業種協業の成果です。

5. パーソナルエージェント AI技術を活用し、車が周囲の環境をセンサー群で理解して能動的に働きかけるエージェントシステムを開発中です。

6. メディアバー 車両前面に配置されたLCDパネル。『AFEELA 1』が外界とコミュニケーションするための装備として、通常は灯体が配置される場所をディスプレイ化するという革新的な試み。法規を遵守しながらの実装には高度な技術開発が必要とされています。

SHMが掲げる「Mobility as a Creative Entertainment Space」の実例として開発が進められている『AFEELA 1』。6つの主要機能で構成されている

「AFEELA Inteligent Drive」こと、AFEELA 1の自動運転デモ動画。フロントパネル内の2つのGUIは、エンターテインメント表現との親和性の高さからUEで開発。どんなシーンでも利用できることを重視して、Level 2+を想定した開発が進められている

ソニーの立体音響技術(360 Spatial Sound Technologies)を採用した「AFEELA Immersive Audio」。Dolby Atmosもサポートしている

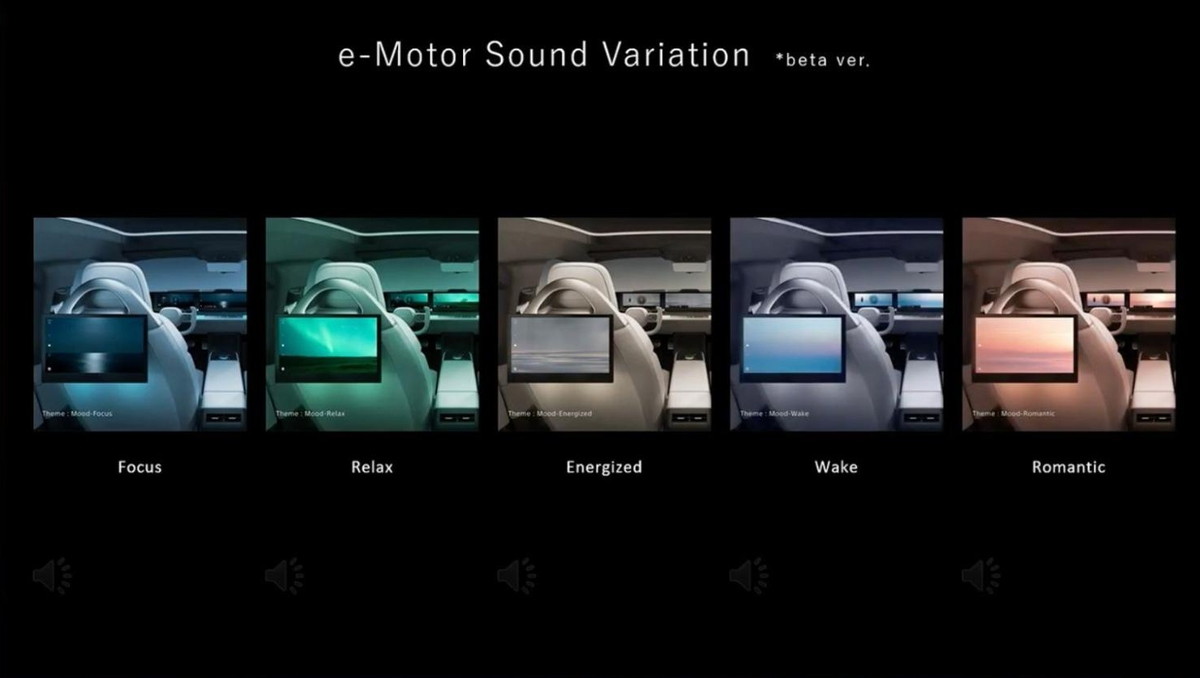

ポリフォニー・デジタルとの共同開発による「e-Motor Sound」。EVは静粛性が高い反面、エンジン音を好むユーザーもいるため、室内空間に疑似エンジン音を再生できる機能を搭載。アンビエントテーマ(室内照明の色調変化)と連動させることも可能

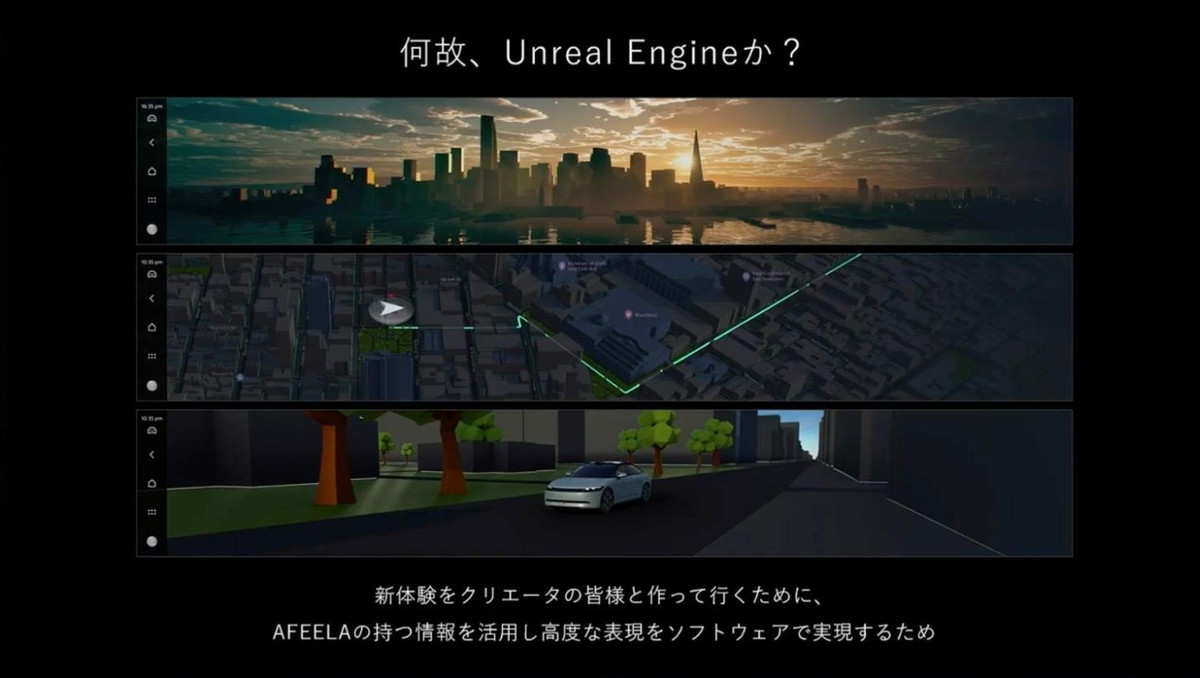

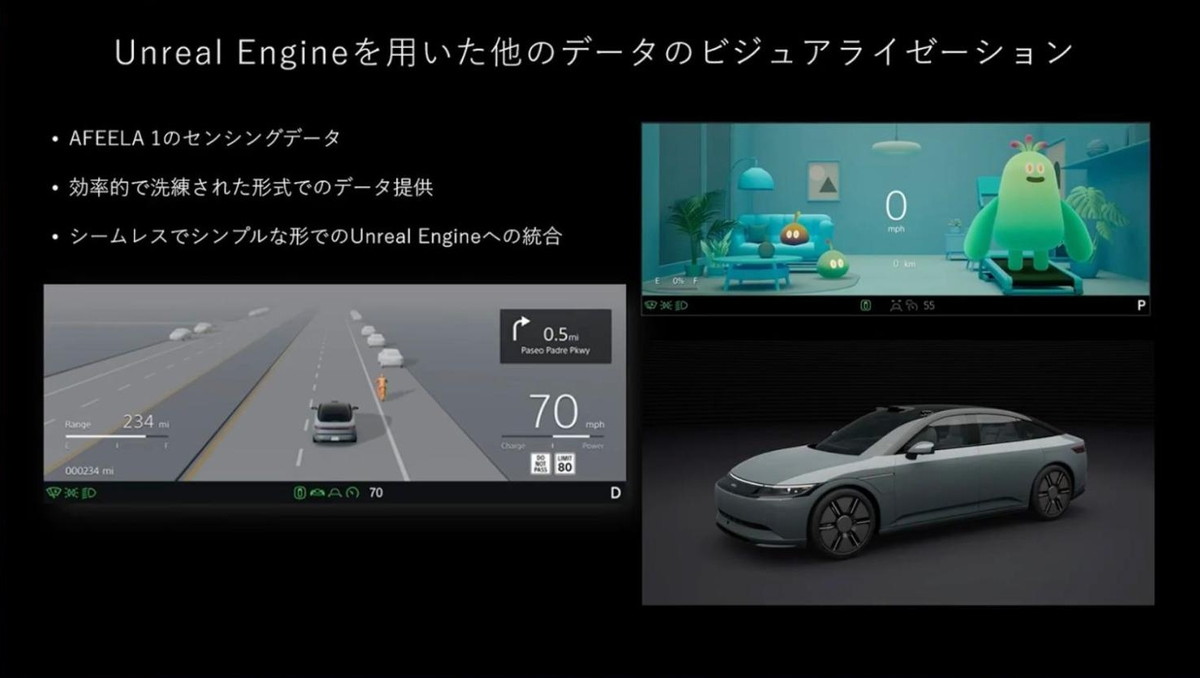

なぜUEなのか――リアルとバーチャルを繋ぐ 続けて西林氏は『AFEELA 1』の開発においてUEを採用した理由を説明しました。

「リアルとバーチャルをつなげたいという強い思いがありました。そこで掲げたのが、先ほどご紹介した3Aと呼んでいる3つのコンセプトです。クリエイターの皆様にこのリアルとバーチャルを繋いでいただくには、ケーパビリティが高いグラフィックスエンジンが必要です。特に現実の3D空間と仮想の3D空間を結ぶには、高性能な3DエンジンであるUEが必要でした」と、西林氏。

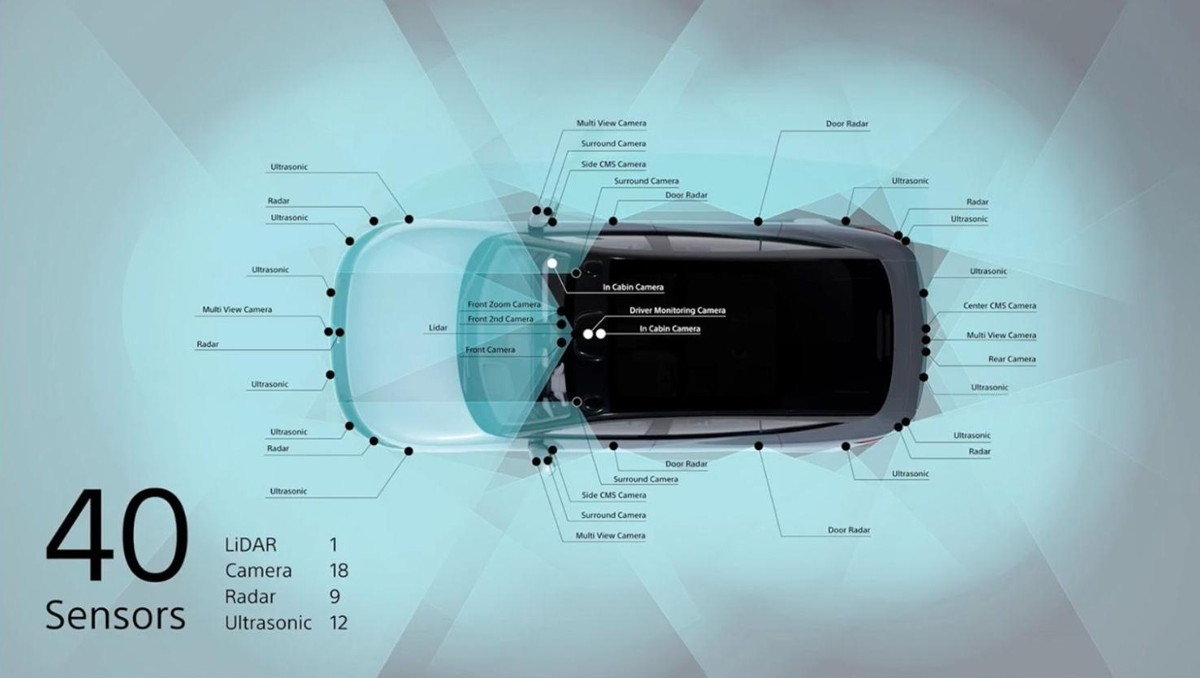

車内外に配置された40個のセンサーから得られるリアルタイムデータを、仮想空間で表現するには、高度なレンダリング能力が求められます。さらにSHMが目指す、クリエイティブエンターテインメントが求めるグラフィックを創るにはUEが最適な選択肢だったそうです。

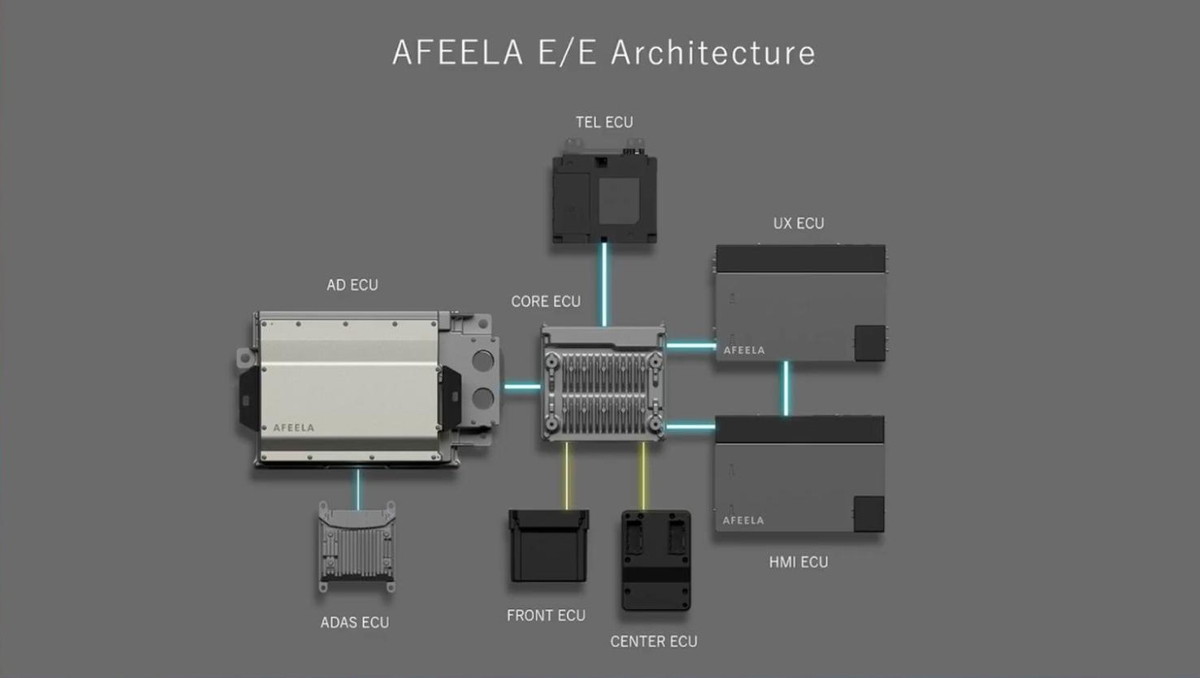

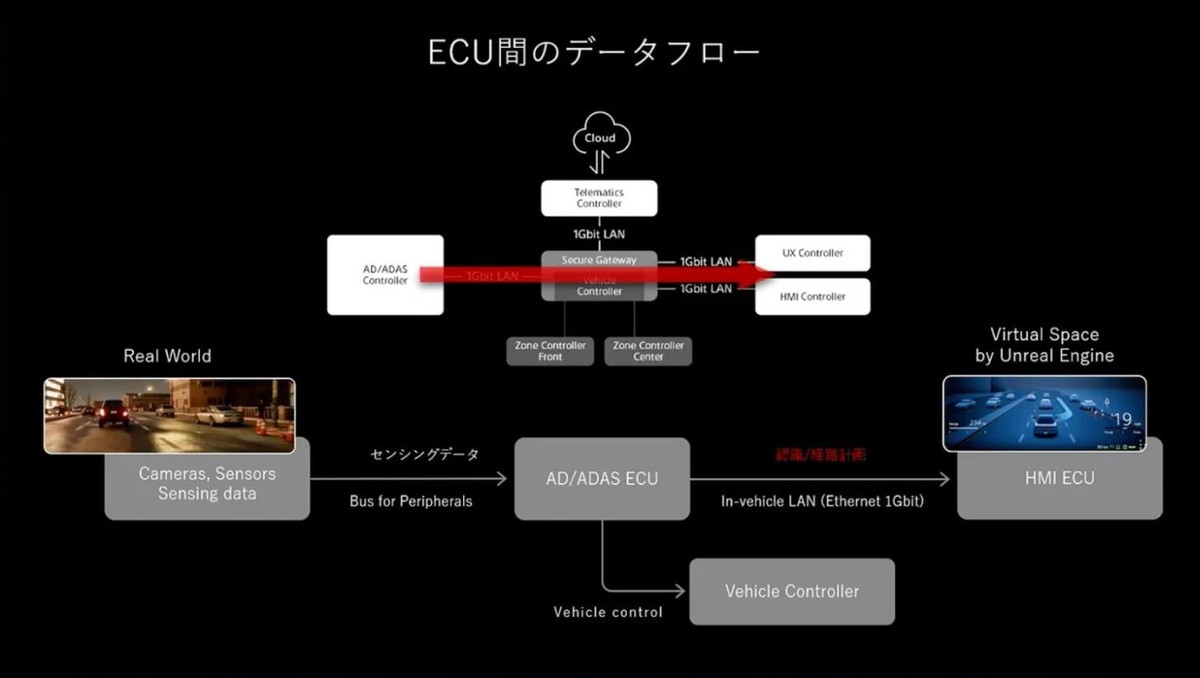

高性能なE/Eアーキテクチャ 具体的な実装を説明するのに先立ち、西林氏よりリアルとバーチャルをつなぐための「E/Eアーキテクチャ(Electrical/Electronic Architecture、電気・電子システム全体の構成設計)」が紹介されました。

リアルとバーチャルをつなぐために、車の内外に40個のセンサーを搭載

センサーデータの処理には、強力なコンピューティングパワーと同時に、低消費電力と通信が必要です。そこで『AFEELA 1』では、クアルコム社のSnapdragonプラットフォームを採用し、以下の3つのECU(Electronic Control Unit)を搭載しています。

AD ECU :自動運転用、800TOPS(Tera Operations Per Second)の演算能力 HMI ECU :ヒューマン・マシン・インターフェース用 UX ECU :ユーザーエクスペリエンス用

AFEELA 1のE/Eアーキテクチャ。AD、HMMI、UXという3種類のECUを搭載。HMIとUXがインフォテイメント関連の処理を担う

これらのECUはGigabit Ethernetで接続され、従来のスタンドアローンのECUではなく、車内ネットワークによって統合された設計となっています。この設計により、AD ECUで処理された自動運転データをリアルタイムでHMI ECUに転送し、UEでレンダリングすることが可能になりました。

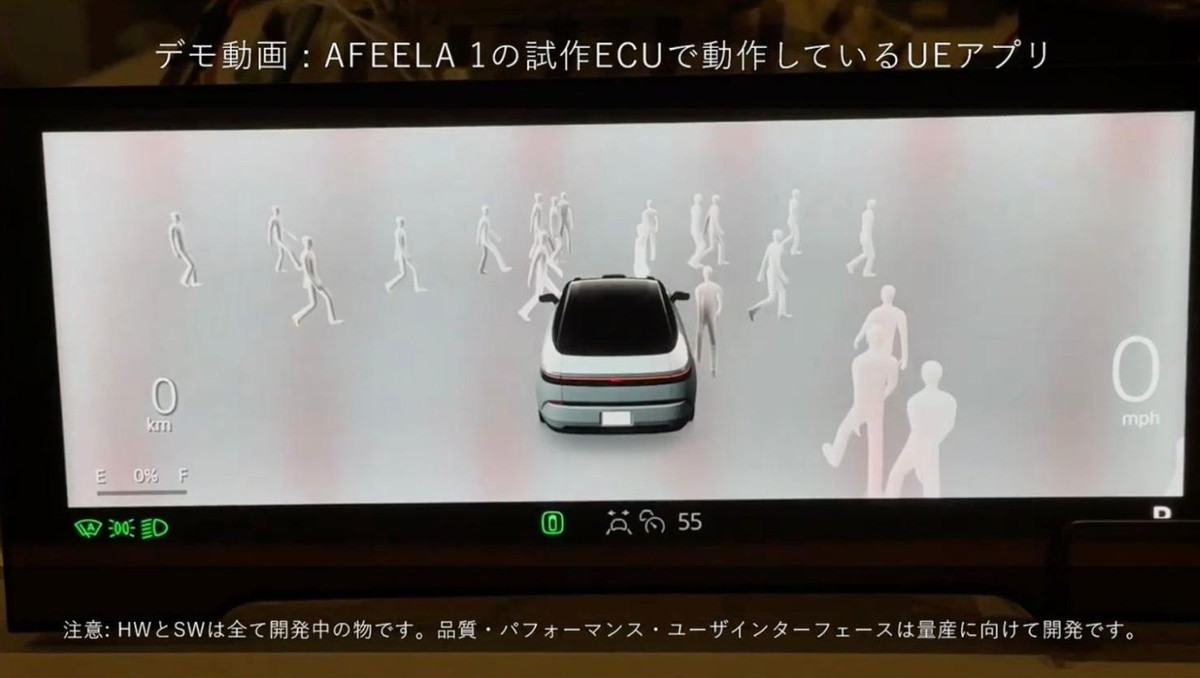

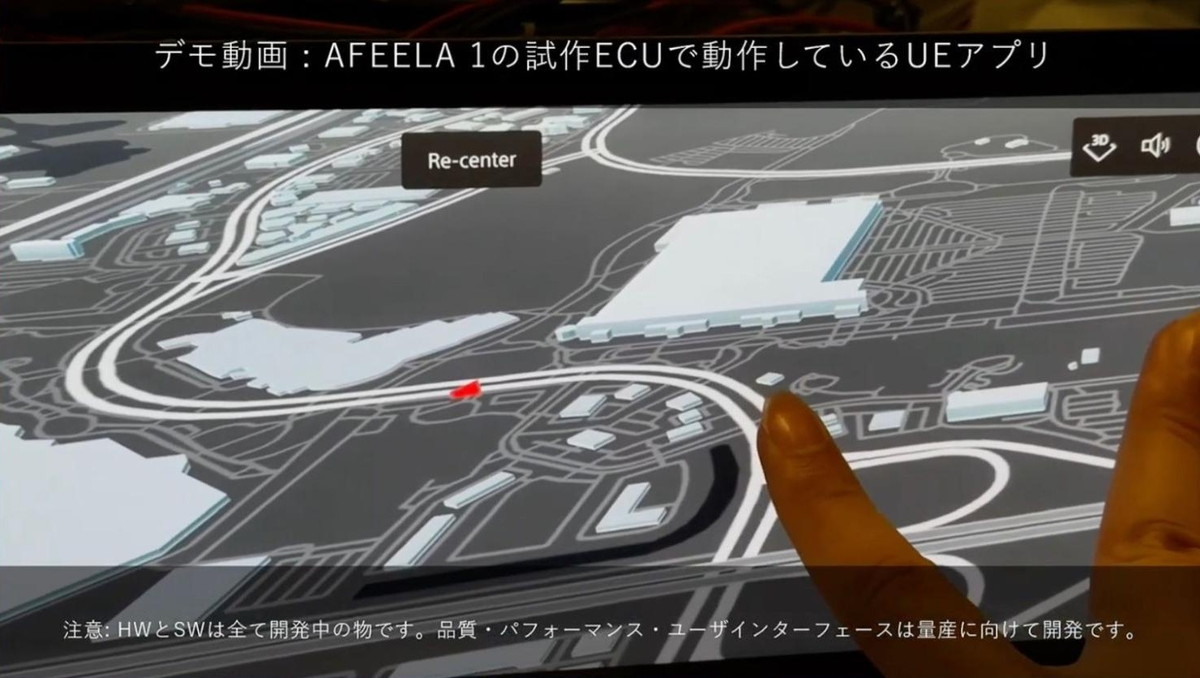

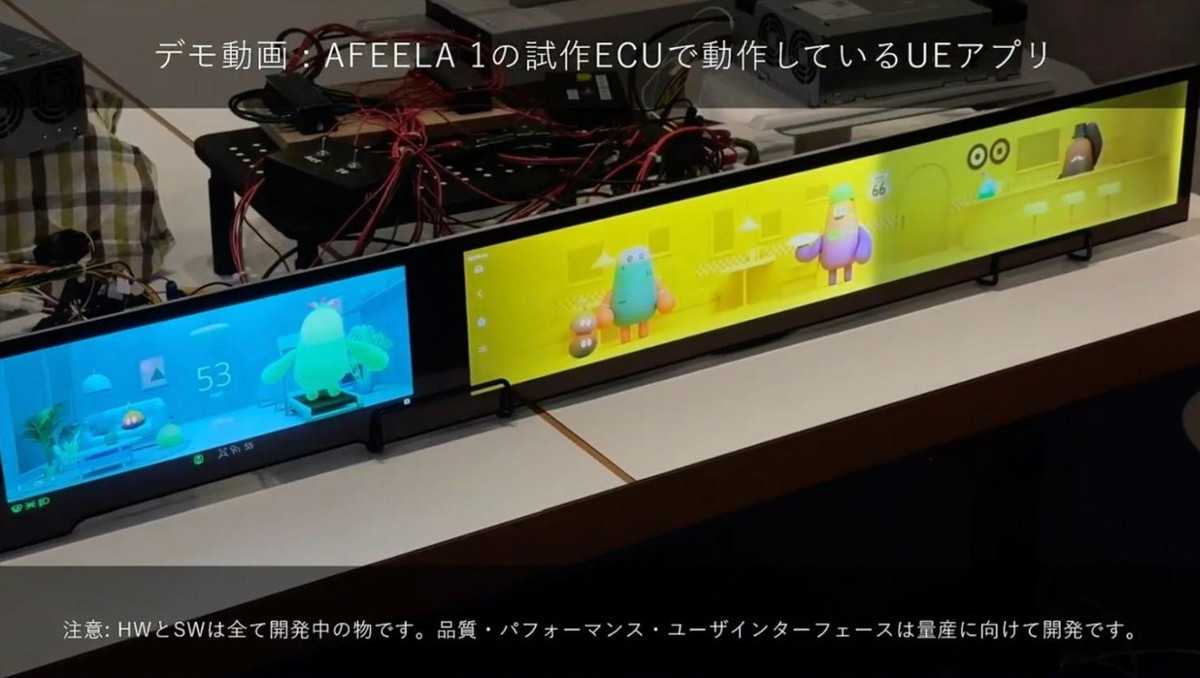

西林氏は実機デモ映像も披露。『AFEELA 1』の試作ECU上で実際に動作するUEアプリケーションが紹介され、車両周辺の状況を3Dグラフィックスで表現する様子が示されました。

AFEELA 1の試作ECU上で動作しているUEアプリのデモ(全て開発中のもの)

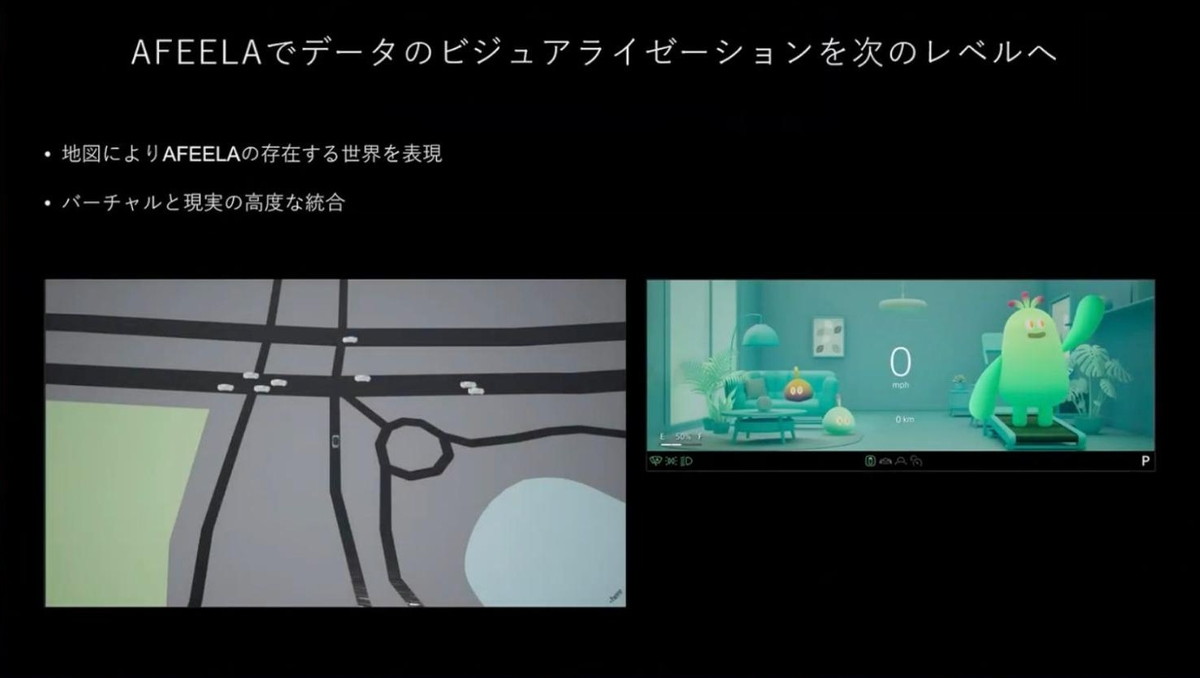

新開発されたHMI向けマップ機能

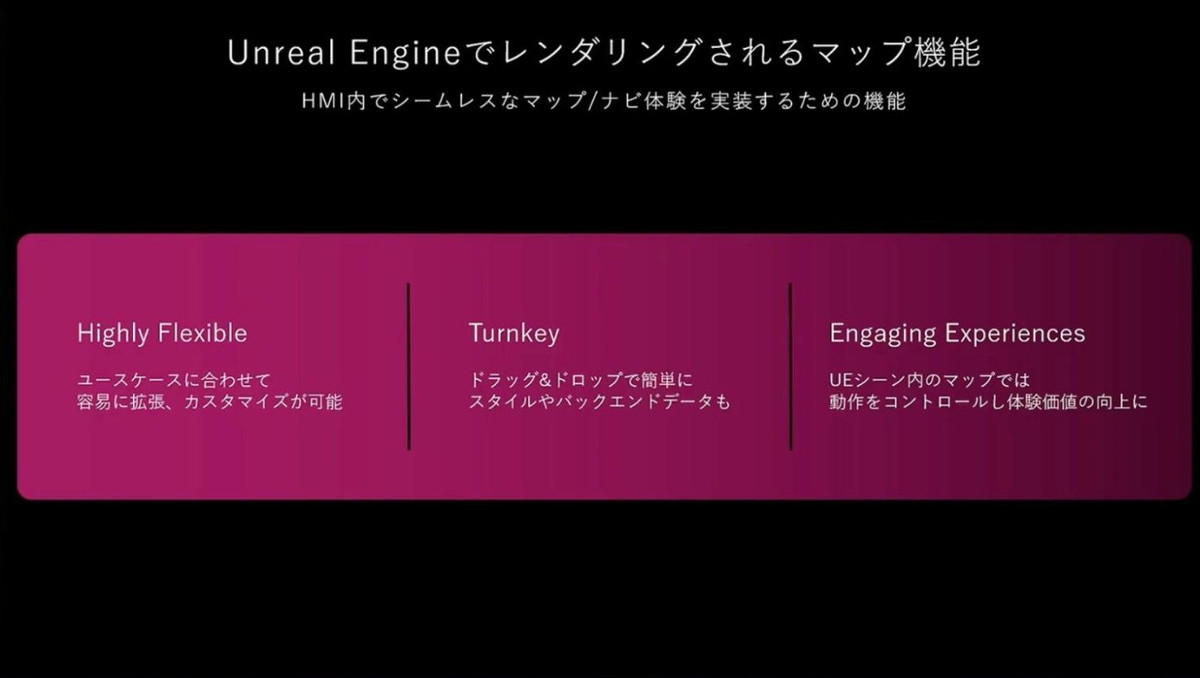

続いて、エピック ゲームズ ジャパン シニアソリューションアーキテクト 向井 秀哉氏が登壇し、UEに新たに実装されたHMI向けマップ機能が紹介されました。

次世代マップシステムの3つの柱 Epic GamesのHMIチームが開発しているマップ機能は、現在リリースに向けて開発が進められており、3つの重要な特徴を持っています。

1. 柔軟性(Flexible) 従来の車載ナビゲーションシステムは、UIとの統合や制御、表示内容に厳しい制限があり、開発できる体験価値の幅が限られていました。しかし、自動運転が一般化するにつれ、単に「地点Aから地点Bへ移動する」だけでなく、特定地域を巡回するなど多様な体験価値が求められています。Epic Gamesのマップシステムは、こうした開発者とユーザーの需要に応えられる柔軟性を実現しています。

2. 使いやすさ(Turn-Key) UEのシーンに簡単にドラッグ&ドロップして使用できる設計を目指しています。HMI開発は多数の要素が絡む複雑な作業であり、マップを簡単に使用できるようにすることで、全体の作業コストを削減できます。

3. 没入感のある体験(Immersive) 自動運転の発達により、現実空間とバーチャル空間のインタラクションや体験価値がより重要になります。地図との新たなインタラクション方法を可能にするマップシステムの実現を目指しています。

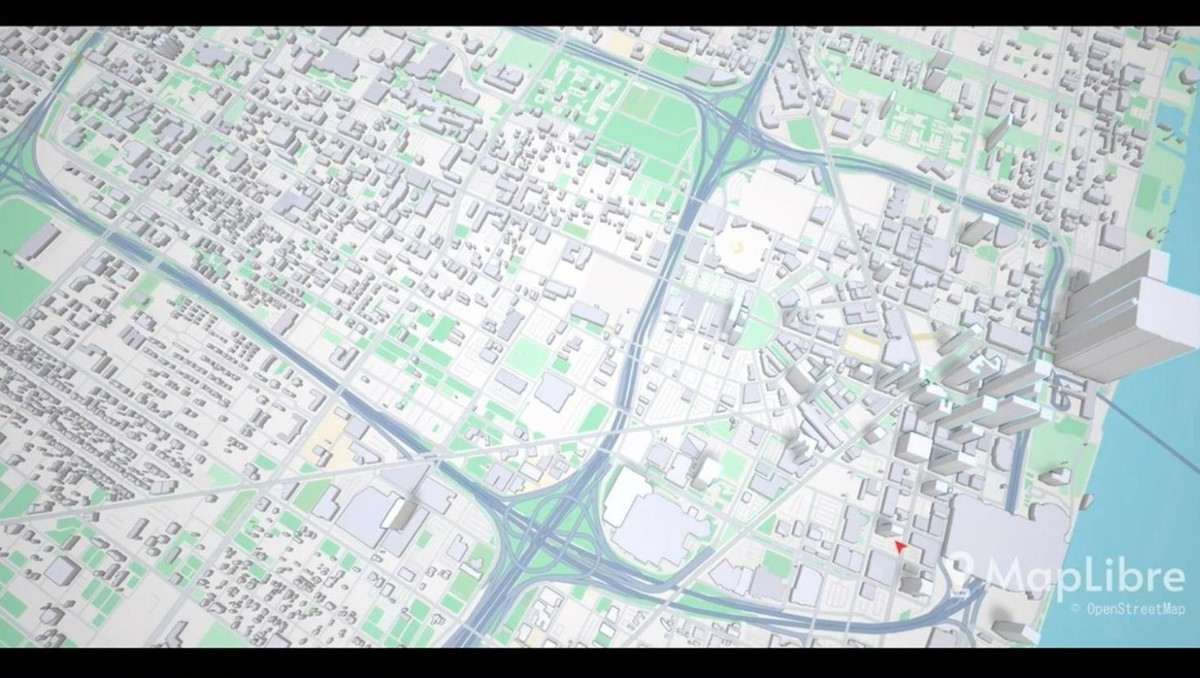

モバイルレンダラーによる多様なビジュアル表現 向井氏はデトロイト、シアトル、ニューヨーク・マンハッタンなど、複数都市のマップデータを使用したデモンストレーションを披露しました。

マンハッタンのフライスルー映像では、3Dで生成された建物やベクターレンダリングされた道路が表示され、夜景から昼間のスタイルへシームレスに遷移する様子が示されました。

Epic GamesのHMIが開発を進めるマップ(デトロイト)

さらに、同じマップデータから以下のような多様なビジュアルスタイルを生成できることが紹介されました。

フォトリアリスティックなスタイル 蛍光表示管(VFD)風のレトロなスタイル ガラスのような透明感のあるスタイル

これらの多様なスタイルは「Unreal Powered Styling」と呼ばれる機能によって実現されており、開発者は自由にマップの見た目をカスタマイズできます。

ガラスのような透明感をもたせたルックの例(マンハッタン)

実用性への取り組み

向井氏は、機能の拡充だけでなく、実際に使えることの重要性も強調しました。

「実際のナビゲーション機能は、渋滞情報など多くのサブシステムと連携しています。これらのサブシステムが全てモバイルハードウェア、つまり車載ハードウェア上で稼働可能な状態になるよう、全力で開発を進めています」

UEの高度なレンダリング機能を、車載という制約のある環境で動作させることは技術的に大きな挑戦ですが、Epic Gamesはこの課題に真摯に取り組んでいます。

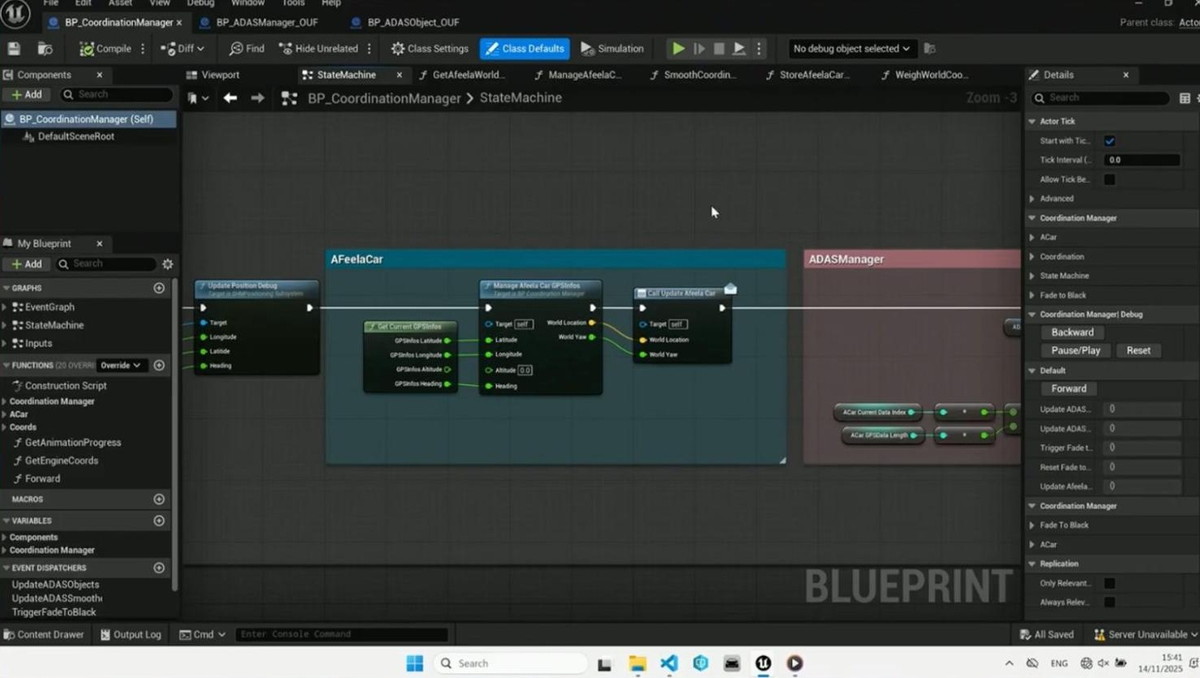

ブループリントによる実装のライブデモ

3番目の登壇者は、キュー・ゲームス ソフトウェアエンジニア ピエール・ミッチ氏。『AFEELA 1』プロジェクトにおけるEpic Mapの実装を担当する同氏が、UEのブループリントを用いた実装方法を解説しました。

リアルタイムセンサーデータとマップの統合 ピエール氏はまず、『AFEELA 1』のセンサーデータとEpic Mapを統合する基本コンセプトを説明しました。

「一方にはUEで表現されるリアルタイムマップがあり、もう一方には『AFEELA 1』のセンサーのライブデータがあります。例えば、ADASは周囲の車や歩行者などを検知できるセンサーです」

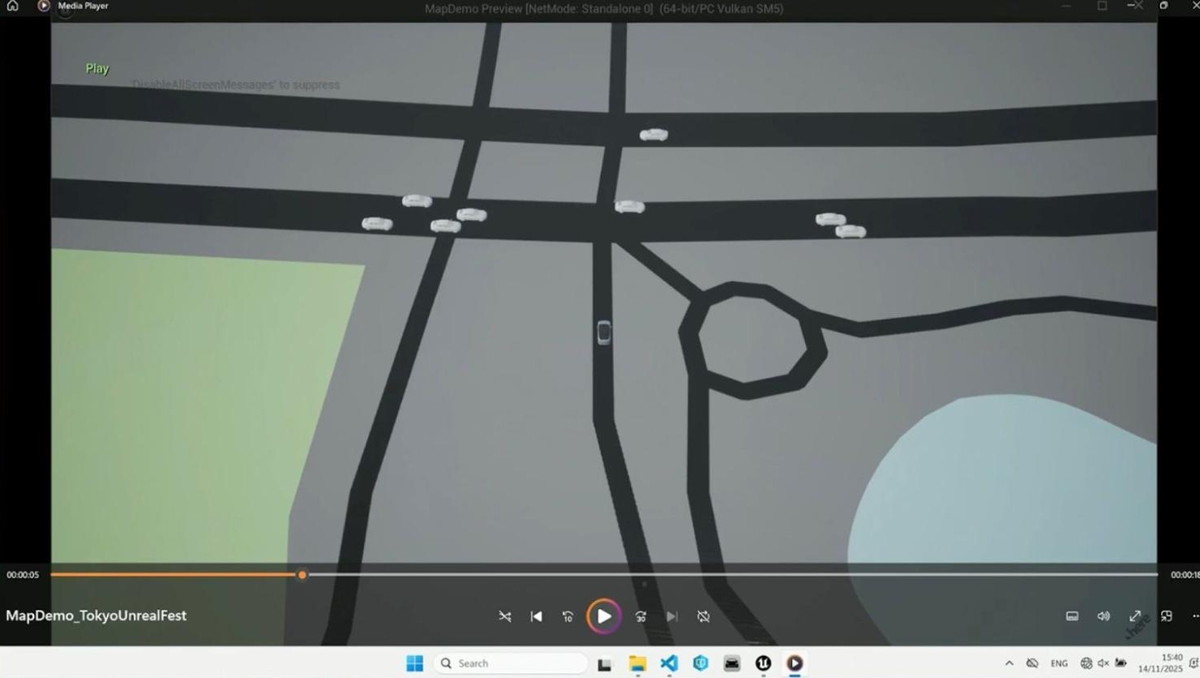

GPSデータのスムージング処理 続けて披露されたデモ動画では、交差点を選択し、『AFEELA 1』がGPS位置情報に基づいて道路上に正しく配置される様子が示されました。周囲の車両や歩行者などのオブジェクトはADASセンサーによって検知され、エンジン上でリアルタイムに可視化されます。

車両データのシミュレーション映像がデモ動画として披露された

GPS位置情報を扱ううえでは「GPSデータのスムージング」が技術的な課題となりました。

「基本的にGPS情報の精度は1メートルより細かい精度では足りないため、そのまま『AFEELA 1』に渡すと動きが震えてしまいます」

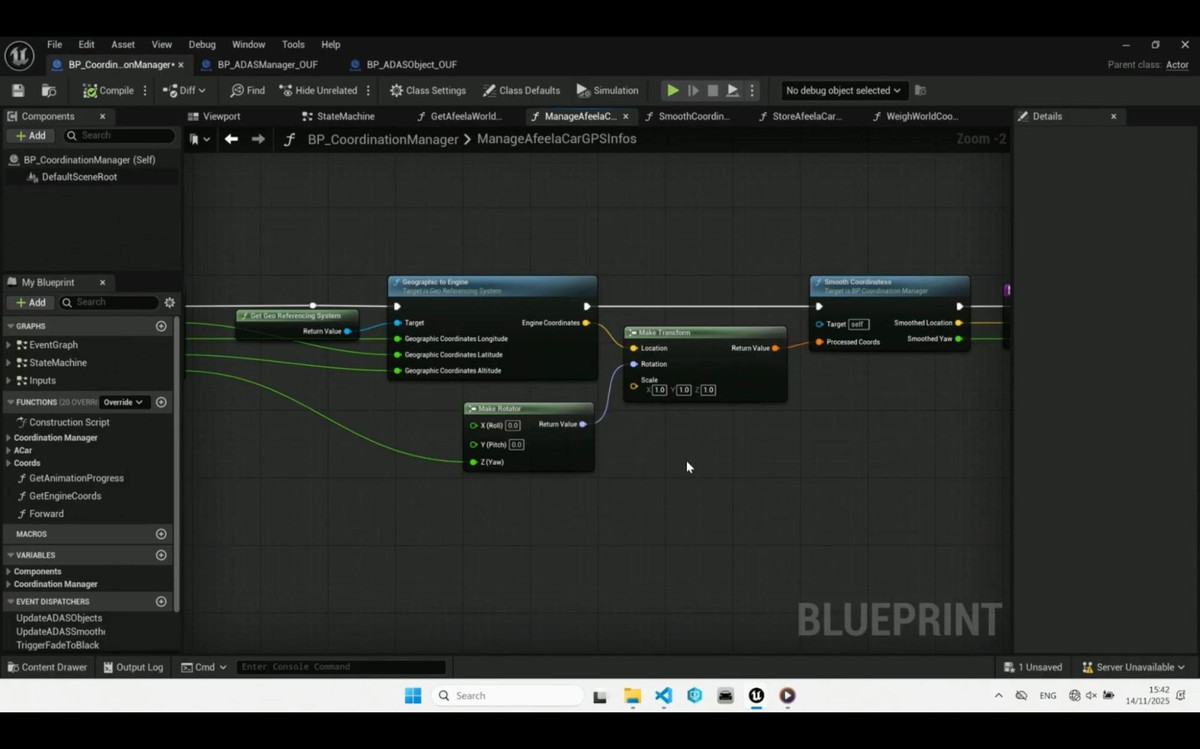

この問題を解決するため、以下の手法が採用されています。

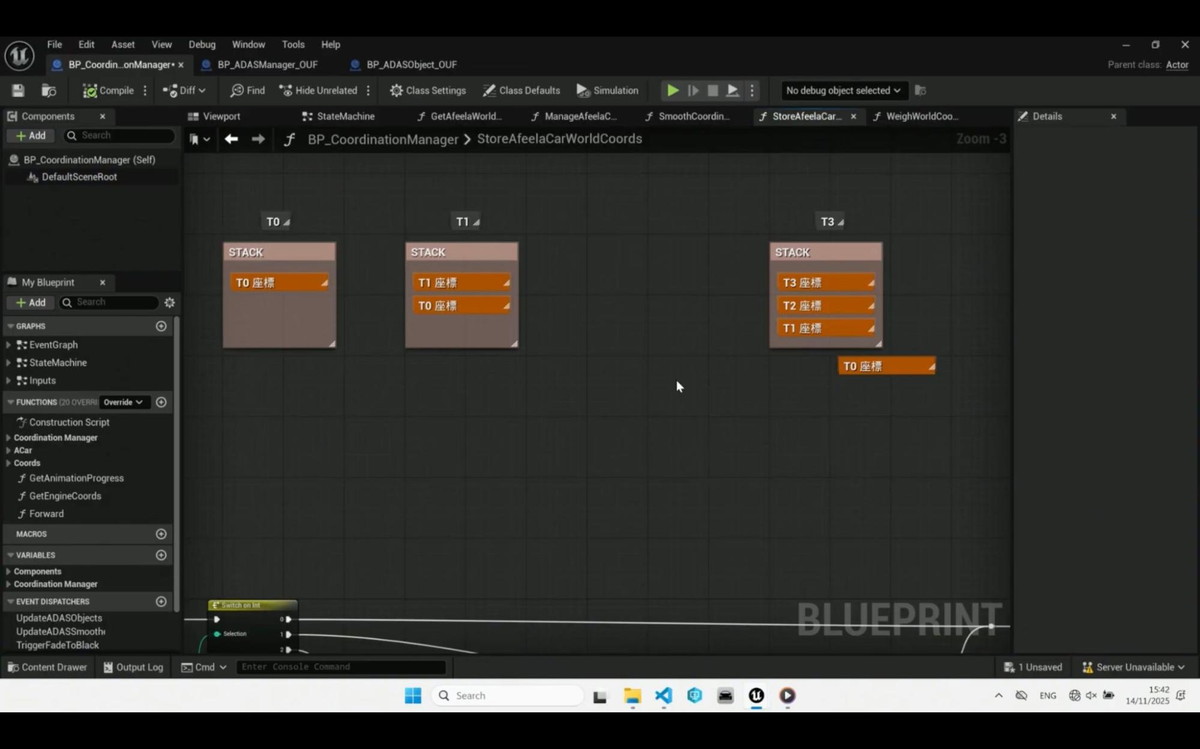

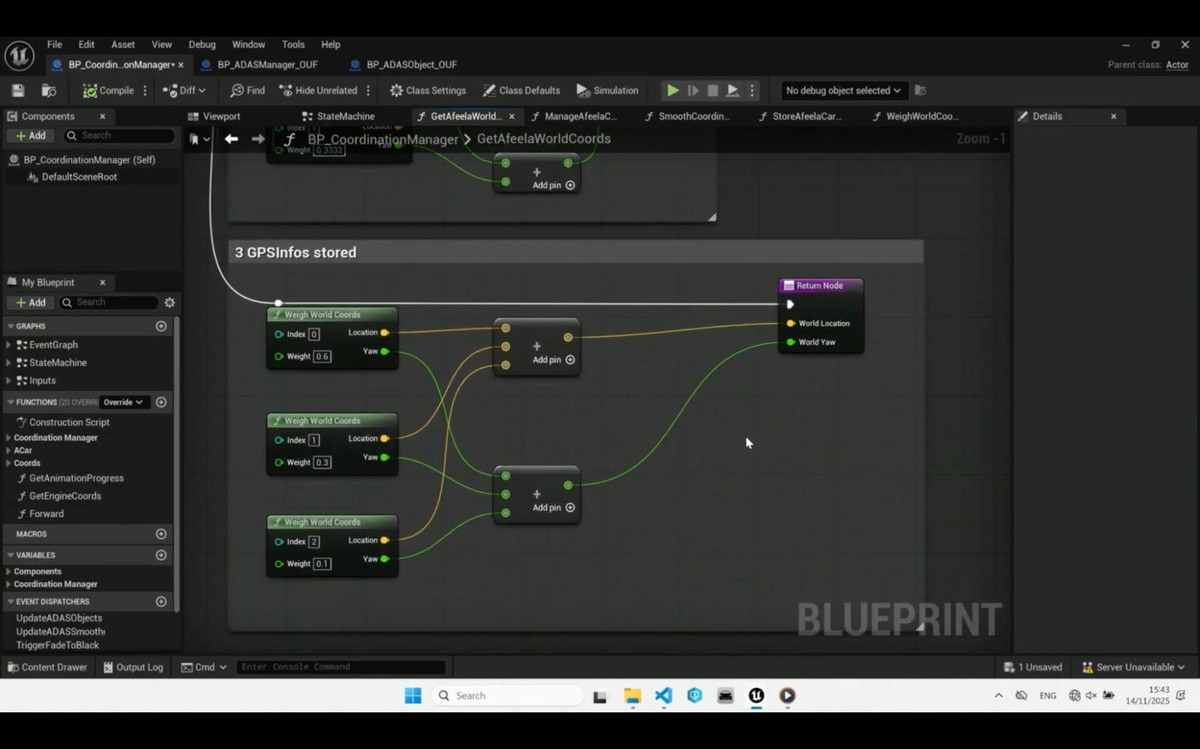

受信したGPS情報を、経度(Longitude)・緯度(Latitude)・高度(Altitude)という3つのデータに分けてスタックに格納 新しい情報を上に、古い情報を下に押し出すキュー構造を使用 3つの情報に重み付けを行い、新しい情報ほど大きな重みを、古い情報ほど小さな重みを適用 重み付け平均によってスムーズな位置データを生成

この処理により、『AFEELA 1』がUEの座標空間で正確に配置されるようになります。

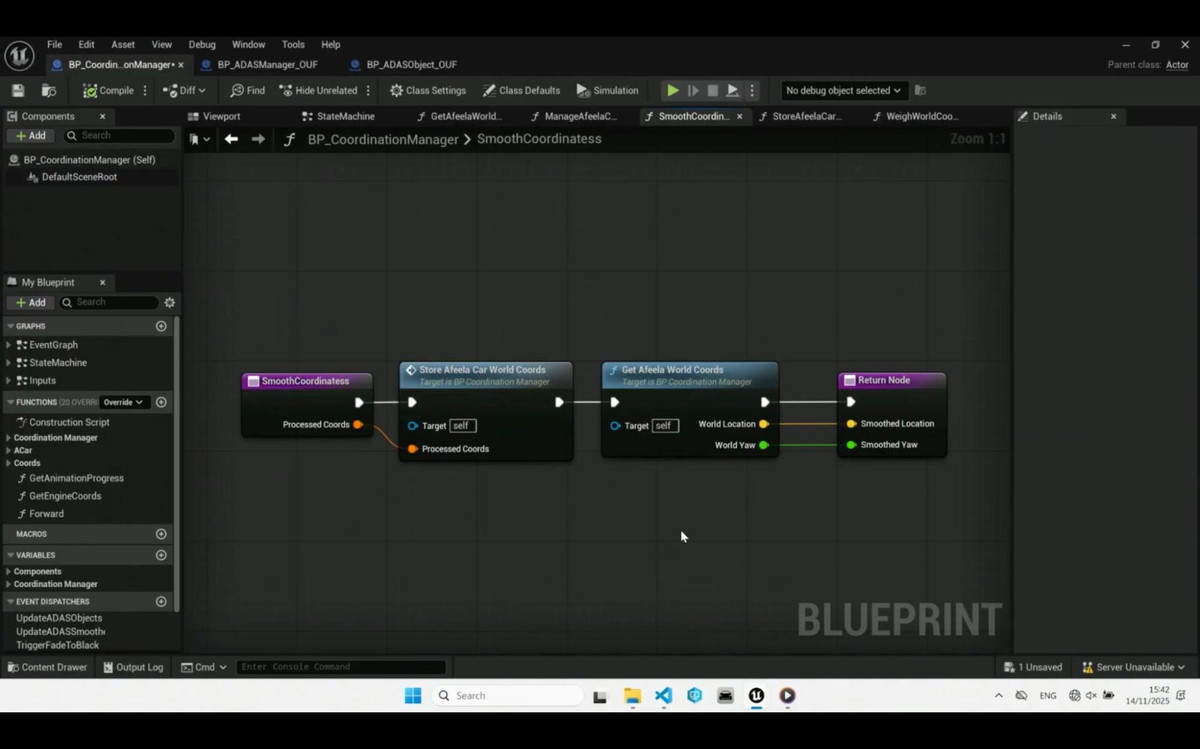

ブループリントで作成した「CoordinationManager」

(図・中央)GPS情報を経度(Longitude)・緯度(Latitude)・高度(Altitude)という3つのデータに分けて格納

3つの情報に重み付けを行い、新しい情報ほど大きな重みを、古い情報ほど小さな重みを適用。その平均によってスムーズな位置データを生成

新しい情報を上に、古い情報を下に押し出すキュー構造(STACK)を使用

そして重み付け平均によって、スムーズな位置データを生成

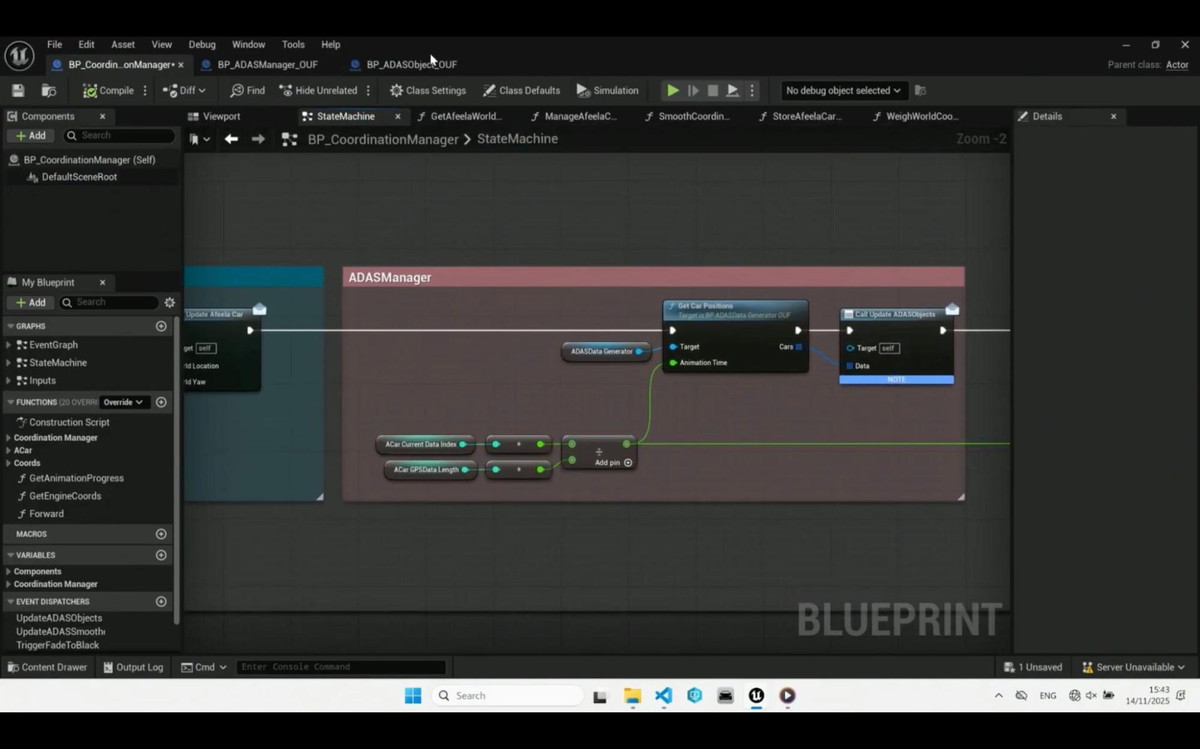

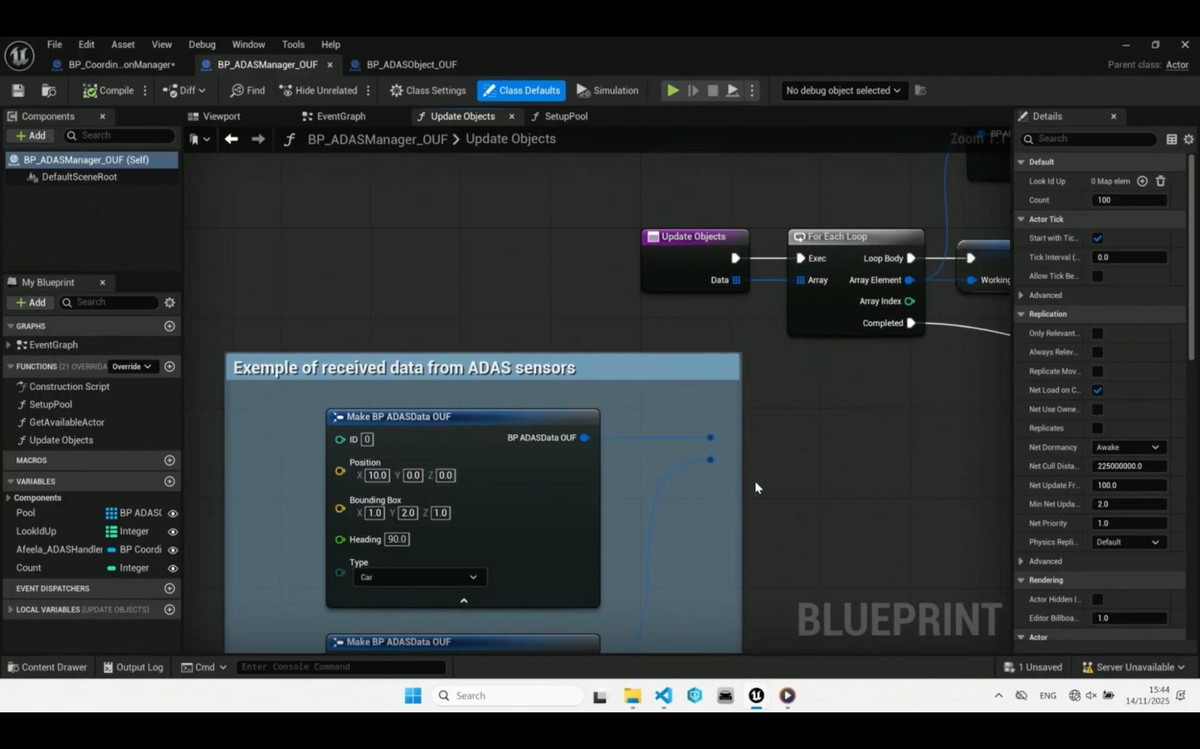

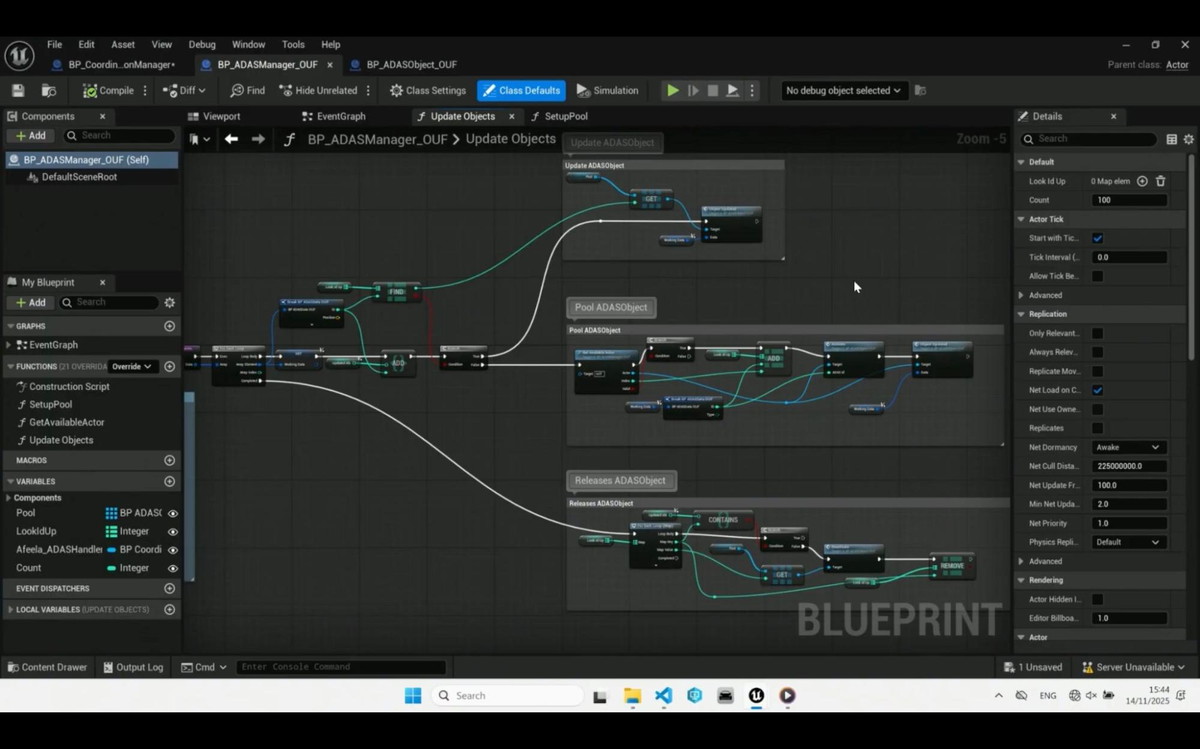

ADASオブジェクトの管理とプーリングシステム ADAS Managerと呼ばれるブループリントクラスは、本質的にはオブジェクトプーリングシステムとして機能しています。

ADASセンサーから送られてくるデータ配列には、検知された各オブジェクトの位置、進行方向、種類などの情報が含まれています。検知された各オブジェクトにはIDが割り当てられ、フレームが変わってもIDの値が変わらないため、オブジェクトの追跡が可能です。

ADAS Managerは、このデータ配列に基づいて以下の処理を行います。

オブジェクトのプール 既存オブジェクトの更新 不要になったオブジェクトの解放

「ADAS Manager」と呼ばれるブループリントクラス

ADASセンサーから送られてくるデータ配列には、検知された各オブジェクトのID、位置(Position)、進行方向(Heading)、種類(Type)などの情報が含まれている

上から順に、ADASオブジェクトの更新、プール、リリース(解放)処理を行うためのクラス

ワールド座標への変換 検知されたオブジェクトをマップ上の正しい位置に配置する処理は、シンプルながら効果的です。

「ADASオブジェクトの座標に『AFEELA 1』のワールド座標を加えることで、ADASオブジェクトを正しく配置できます」

相対座標で表現されたセンサーデータを、車両のワールド座標を基準に変換することで、マップ上の正しい位置に配置されます。回転についても同様の処理が適用されます。

車内センサーの活用 ピエール氏は、車外のセンサーだけでなく、車内センサーも活用していることを明らかにしました。

ダッシュボードには「ドラトモ」と呼ばれる小さなキャラクターが配置されており、ユーザーの操作に反応するとのこと。例えば、車が走行中はドラトモも走り、運転者がドアを開けるときにはドラトモが手を振って見送るといった演出が実装されています。

このように、ブループリントを活用することで、複雑なセンサーデータの処理とビジュアル表現を統合した、洗練されたHMI体験が実現されています。

図・右上のキャラクターが「ドラトモ」。ユーザーの操作内容に応じて、様々な動作を行うというインフォテイメントが実装されている

『AFEELA 1』システムアーキテクチャの全体像

最後に、ソニー・ホンダモビリティ ソフトウェアエンジニア 山口 雄也氏が登壇し、『AFEELA 1』のシステムアーキテクチャ全体についての解説を行いました。山口氏は、IVI(In-Vehicle Infotainment、車載インフォテイメント)のソフトウェアエンジニアとして、HMI のアプリケーションとプラットフォームの開発に携わっています。

高帯域データ転送を可能にするネットワーク設計 『AFEELA 1』は、センサーデータや認識された障害物などの情報をIVIに直接送信できる高帯域Ethernetを備えています。

「これらのデータは車両制御だけでなく、IVIのインフォテインメントやエンターテインメントにも活用できます。1Gbps Ethernetを介して伝送され、ソフトウェアによって動的に制御できます」と、山口氏。

IVIの要求に応じて必要なデータを取捨選択しながら、ADAS ECUからHMIへデータを転送できる設計になっています。

さらに、カメラには個別の10Gbps専用ラインが用意されており、フロントカメラ、リアカメラ、サラウンドカメラという複数カメラからの画像データを非圧縮でHMIに伝送できます。

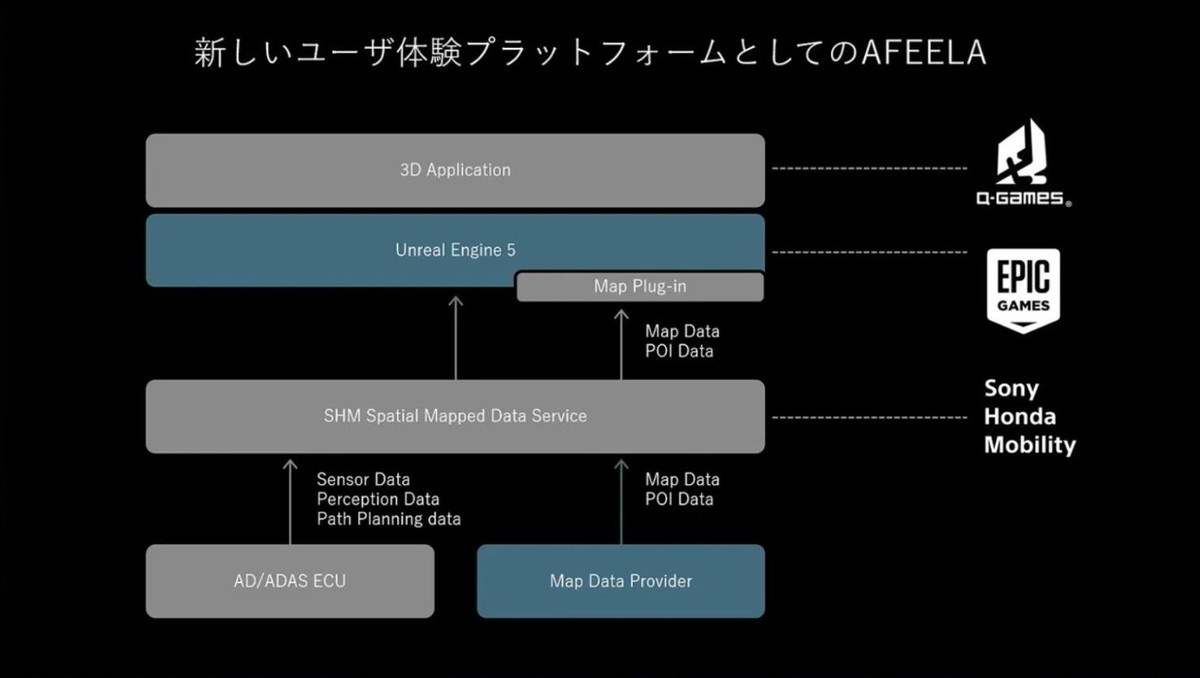

3社協業による統合プラットフォーム 山口氏は、『AFEELA 1』のプラットフォームが様々なパートナーとの協業によって実装されていることを強調しました。

ソニー・ホンダモビリティの役割 「Spatial Mapped Data Service」と呼ばれるデータプラットフォームを開発。ADAS ECUからのセンサーデータ、パーセプション(認識)データ、パスプランニング(経路計画)データと、マッププロバイダーからのマップデータやPOI(Point of Interest)データを受け取り、UEに届ける役割を担います。

Epic Gamesの役割 様々なプロバイダーのニーズに対応し、サポートを考慮したマップレンダリングのためのコアプラグインを開発。今回の協業により、『AFEELA 1』のサポートも可能になりました。

キュー・ゲームスの役割 これらのデータとUEのプラグインを活用した3次元アプリケーションの開発を担当しています。

このように、データ供給、エンジン機能、アプリケーション実装という3つのレイヤーを3社が分担することで、効率的な開発体制が実現されています。

『AFEELA 1』のプラットフォームが様々なパートナーとの協業することによって、クリエイティブエンターテインメントスペースという、よりリッチな体験の実現を目指している

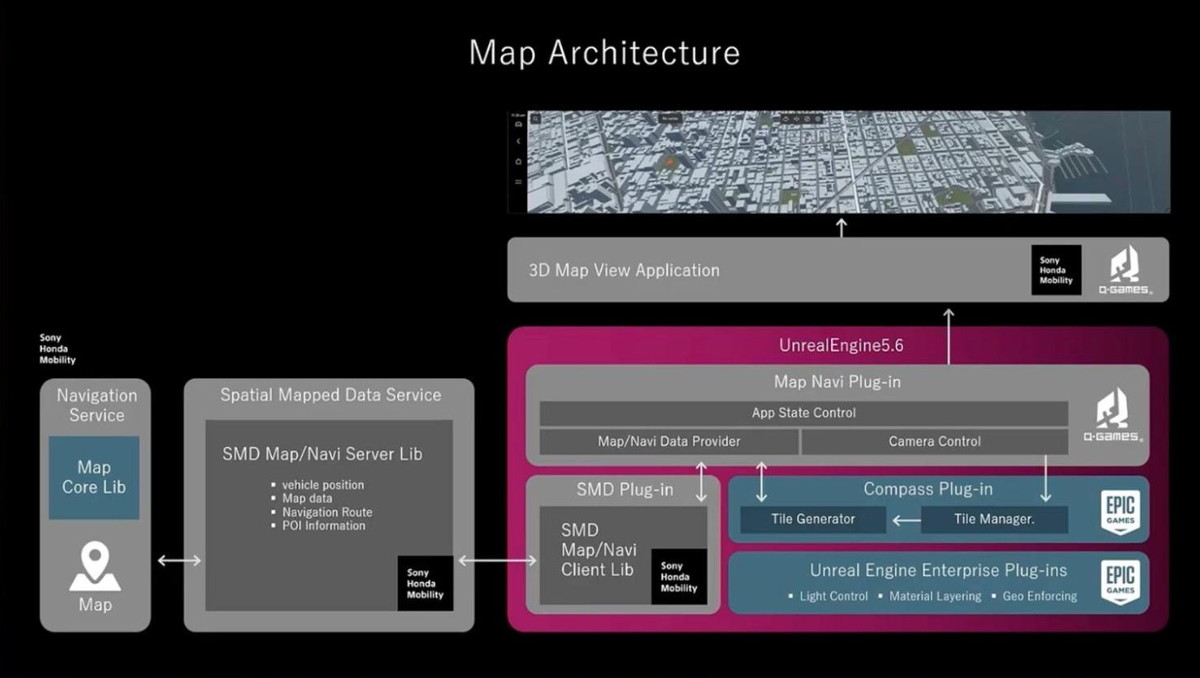

UEによる3次元空間の再現 山口氏が特に強調したのは、UEを使用して3次元空間を再現できるようになったことです。

「UEのCompassプラグインはマップデータを階層的にインポートできるので、モバイルに最適な形でデータをインポートできます。さらに、スタイリングプラグインを通じて、柔軟に表現を調整することも可能です」と、山口氏。

アプリケーション内でのデータフローは以下のように設計されています。

ユーザーのタップアクション、車両のGPS情報に従った移動、POIレコメンドなどによってビューが変化 ビューの変化に応じて、Compassプラグインがフラスタム(視錐台)を考慮しながら表示すべきタイルデータを選択 SMD(Spatial Mapped Data)サービスクライアントのAPIを通じてタイルリクエストを実行 取得したメタデータ形式のタイルデータを、タイル変換プロセスで3Dメッシュ構造を含むタイルデータに変換 UEでスタイリングされ、印象的なオブジェクトとして表示

このプロセスは効率的かつ最適化されており、モバイル環境でも高品質な3Dマップレンダリングを実現しています。

マップ表示のアーキテクチャ。UEのCompassプラグインはマップデータを階層的にインポートするため、モバイルに最適な形でデータをインポートできる

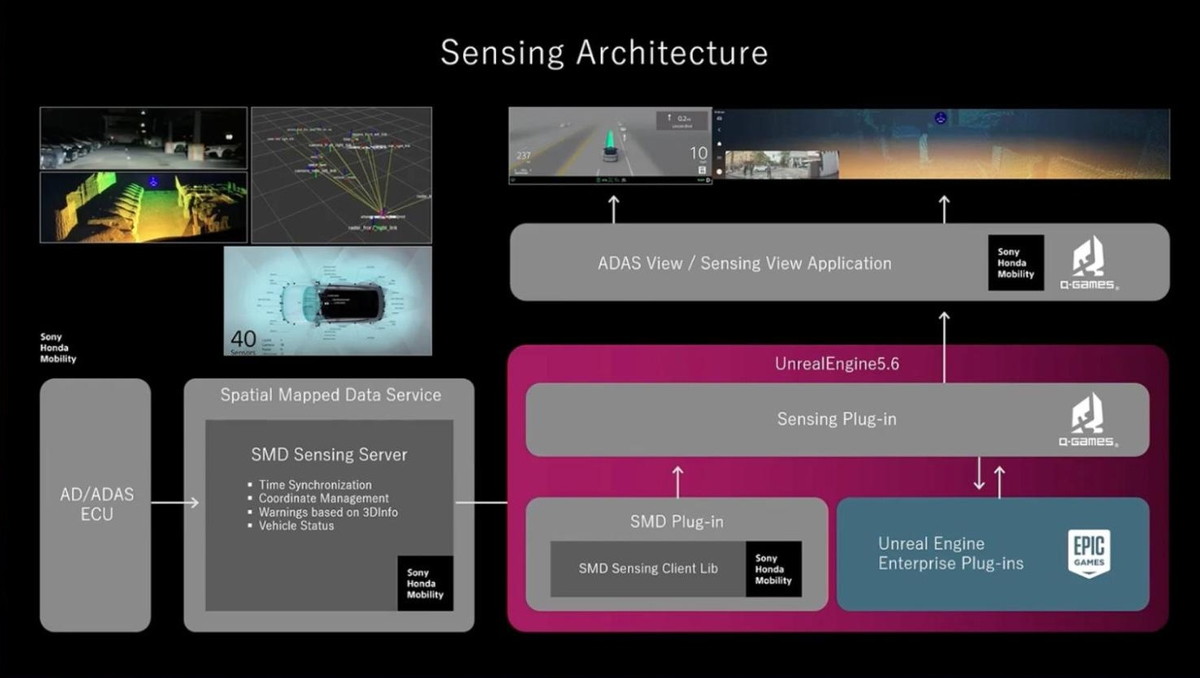

現実世界のデータとの統合 『AFEELA 1』は、現実世界のセンサーデータや認識データを3Dマップ上に統合表示することが可能です。

山口氏は、このメカニズムの技術的詳細を説明しました。「これらのデータは時間的に同期され、Roboticsで使用されているのと同様な座標系を用いて管理されます。このメカニズムによって、複数のセンサーによって取得された認識データやセンサーデータそのものを容易に統合することができます」。

さらに、車両制御情報や警告情報も、空間的および時間的に関連付けられた形で転送されます。これらのデータをUEに取り込むことで、動的に変化する世界を表現できるようになっています。

センシングのアーキテクチャ。一連のデータは時間的に同期され、Roboticsで使用されているのと同様な座標系を用いて管理されており、複数のセンサーによって取得された認識データやセンサーデータを容易に統合することが可能とのこと

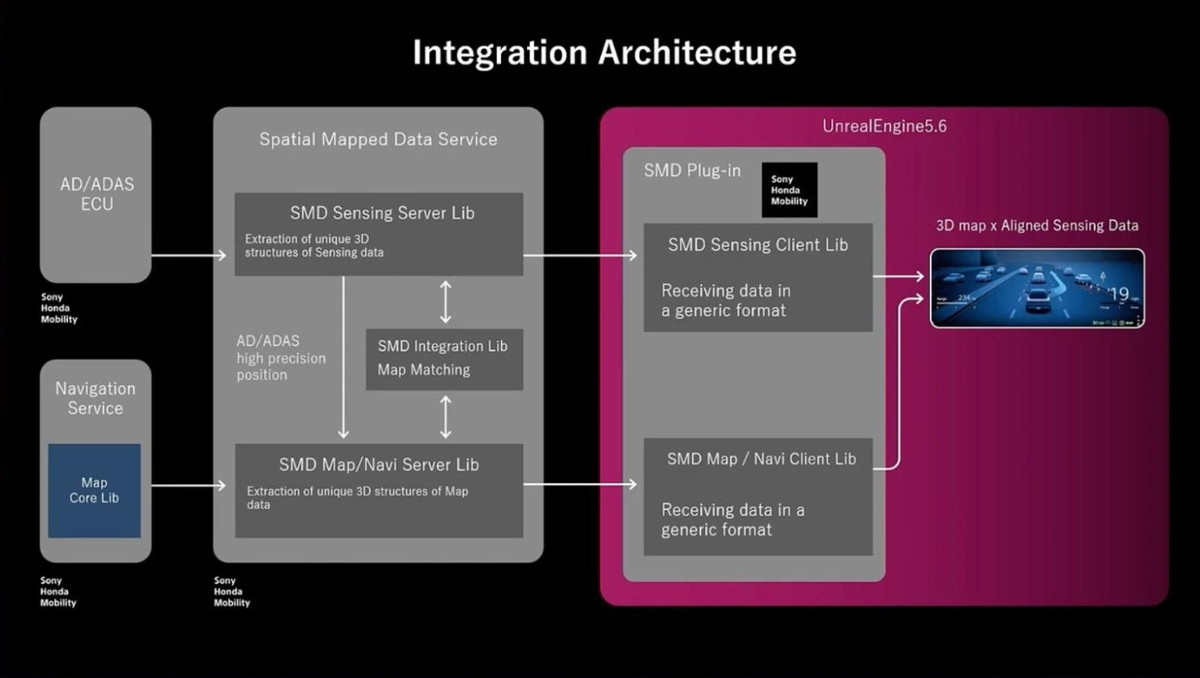

高精度なアライメント技術 センサーデータとマップデータの統合で重要なのが、両者の高精度なアライメント(位置合わせ)です。

山口氏は次のように説明しました。「センサーデータ、マップデータ、センサーで認識された認識オブジェクトなど、それぞれ3次元の特徴量を抽出し、マッチングを行うことで高精度にアラインすることができます。このマッチングプロセスにより、車両の地図上での位置が修正され、センサーデータを地図上に正確に重畳することができます」。

インテグレーションのアーキテクチャ。高精度のアライメント技術により、現実世界の生きた情報を仮想世界の3次元空間に投影することが可能になった。図は、実際に車両が認識している先行車や対向車を地図上に表示したり、経路計画を3次元の地図上に表示する例を示したもの

AFEELAシステムアーキテクチャの特徴

山口氏は、『AFEELA 1』のシステムアーキテクチャの特徴を以下の3点にまとめました。

センサーデータと地図データを連携して使用可能 UE上で自由に表現をカスタマイズ可能 新しいモビリティエンターテインメントを作り上げるプラットフォーム

「『AFEELA 1』のコンセプトのように、できるだけ多くのクリエイターやエンジニアの方々が協力できるようなプラットフォームを作っていきたいと考えています」と山口氏は総括して講演を終えました。

『AFEELA 1』製品ページ 「Unreal Fest Tokyo 2025」イベントページ

フリーランス編集者&ライターほか。総合商社プラント営業>CM系オフラインエディター>CGWORLD>Vook>独立。Hello, I’m a Japanese editor focus on film, video & digital contents.

https://www.linkedin.com/in/arhtn3109/